“老师,我们公司想搞AI,能不能帮我们变个魔术?”

这是我最近在咨询中最常听到的一句话。当我问他们具体想解决什么问题时,得到的回答往往是:“我们也不知道,但感觉AI很厉害,应该能帮我们赚更多钱吧?”

这种心态,恰恰是当前AI热潮中最危险的陷阱。

让我告诉你一个残酷的现实:过去三年,超过70%的企业AI项目以失败告终。不是技术不够先进,而是企业把AI当成了“魔法棒”——以为挥舞一下,业务问题就会自动解决。

🤔 为什么你的AI项目会失败?

因为你忽略了AI的本质:它是一门生意,不是魔法。

看看这些真实的失败案例:

- 某零售巨头投入千万构建AI推荐系统,结果发现准确率还不如人工经验的简单规则

- 某制造企业引入AI质检系统,却因数据质量太差导致误判率高达30%

- 某金融机构跟风上马大模型,最后发现合规风险远大于业务价值

这些项目的共同点是什么?他们都把技术放在了业务前面。

💡 AI成功的真正密码

成功的AI项目都有一个共同特征:从业务痛点出发,而不是从技术酷炫出发。

我亲眼见证的一个转型案例:一家传统制造企业,最初也想搞“高大上”的预测性维护AI系统。但在深入分析后,他们发现最迫切的需求其实是生产排程优化——这个看似“不性感”的问题,每年影响着数千万的利润。

他们调整方向,用简单的机器学习算法优化排程,三个月内就实现了15%的效率提升,ROI超过300%。这才是AI价值的真实体现。

🎯 本专栏的独特价值

这不是又一个“AI科普”专栏。市面上已经有太多讲解Transformer、大模型原理的内容。那些知识重要,但对于企业决策者和实践者来说,更迫切的问题是:

- 如何判断我的业务是否适合AI?

- 如何用最低成本验证AI价值?

- 如何避免成为那70%的失败案例?

- 如何让AI真正产生商业回报?

这正是本专栏要解决的核心问题。

📊 AI商业化的三个层次

根据我对数百个AI项目的跟踪研究,成功的AI商业化通常经历三个演进阶段:

第一层:效率提升(省钱)

- 自动化重复性工作(如文档处理、数据录入)

- 优化现有流程(如供应链调度、排产优化)

- 典型ROI:6-12个月回本

第二层:收入增长(赚钱)

- 个性化推荐和营销(如电商、内容平台)

- 智能产品功能(如语音助手、智能客服)

- 典型ROI:提升营收5-20%

第三层:模式创新(值钱)

- 创造全新业务模式(如AI驱动的订阅服务)

- 构建数据护城河(如行业专属大模型)

- 典型ROI:估值倍数提升

大多数企业应该从第一层开始,但现实中很多企业却盲目追求第三层,这是失败的主要原因。

🔍 专栏内容地图

接下来的章节,我将带你走完AI商业化的完整旅程:

技术地基篇(第2-4章)

- 从最简单的线性回归到Transformer,用生意人的语言讲技术

- 重点不是公式推导,而是“什么业务问题用什么技术”

- 帮你建立技术选型的“商业直觉”

行业实战篇(第5-8章)

- 电商、金融、医疗、制造四大行业的深度案例

- 每个案例都包含完整的ROI分析和避坑指南

- 你可以直接对照自己的行业“抄作业”

落地方法论篇(第9-13章)

- 如何向老板汇报AI项目(他们真正关心什么)

- 从POC到规模化落地的完整路线图

- 决策者最常问的10个灵魂拷问(和标准答案)

进阶成长篇(第14-17章)

- 初学者30天速成计划

- 从业者如何把AI能力“变现”

- 未来3年AI发展趋势和机会判断

🚀 开始前的准备动作

在深入后续内容前,请你先完成一个简单的练习:

用一句话说清楚:我的业务中,哪个具体问题最应该用AI解决?

要求:

- 必须是具体的业务问题(如“客服响应速度慢”)

- 不要涉及技术术语(如“想用大模型”)

- 最好能估算解决后的价值(如“每年节省50万人工成本”)

这个问题的答案,将是你学习本专栏的“北极星指标”。

💎 核心观点

记住这句话:AI的价值不在于技术有多先进,而在于业务问题有多重要。

技术会过时,算法会迭代,但生意的本质不会变——创造价值,获得回报。

从现在开始,忘记“AI”这个词,把它替换成“业务解决方案”。你的思维模式转变了,AI项目的成功率就已经提高了50%。

下一章,我们将从最基础的技术概念开始——但请放心,我会用你最能理解的“生意语言”来讲解。你会发现,原来线性回归和你的销售预测报表如此相似。

朋友们,如果你觉得AI是魔法,那这一章就是教你拆穿魔术的秘密。但别担心,我们不会像大学教材那样堆砌公式,而是用"生意人"的语言,告诉你每个技术到底能解决什么实际问题。

🔍 为什么70%的AI项目会失败?

在前一章我们已经看到,那些失败案例的共同点就是:技术跑在了业务前面。零售企业花大价钱搞推荐系统,结果准确率还不如人工规则;制造企业上马预测性维护,却因为数据质量太差导致30%的误判。

这些教训告诉我们:选对技术比用最酷的技术更重要。

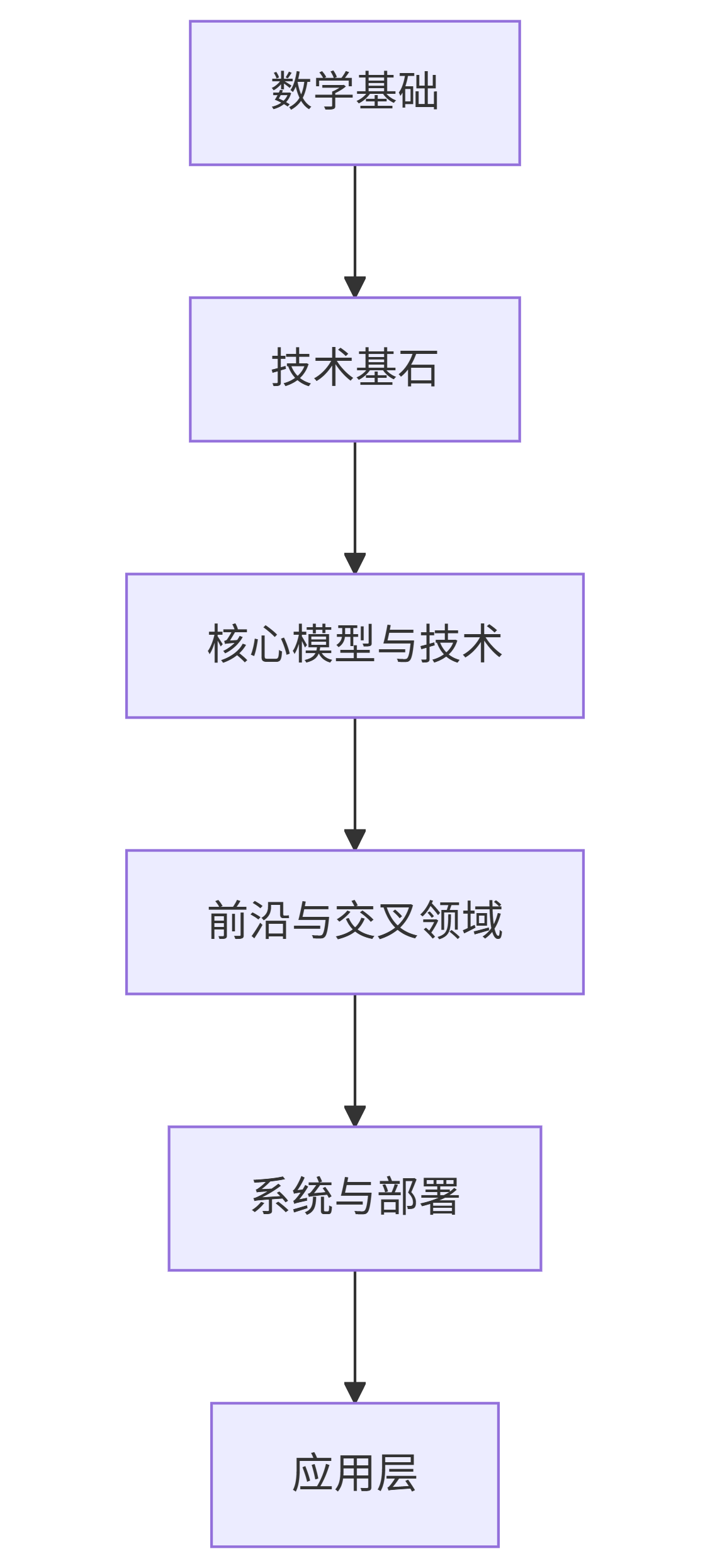

🏗️ AI技术栈的三层结构

想象一下建房子,你得先打地基,再砌墙,最后装修。AI技术也是同样的逻辑:

第一层:数学基础 – 这是地下的钢筋水泥

- 线性代数:不是让你背矩阵公式,而是理解"数据怎么排列最省空间"

- 概率统计:核心就一句话"从历史数据中找规律"

- 微积分:关键是理解"怎么一步步优化到最佳状态"

第二层:经典算法 – 这是房子的承重墙

- 线性回归:最简单的"趋势预测"工具

- 决策树:像老中医问诊一样"层层排除"

- 聚类分析:自动给客户分群的"智能标签机"

第三层:深度学习 – 这是精装修和智能家居

- 神经网络:模拟人脑的"模式识别机器"

- Transformer:当前大模型的"发动机"

💡 技术选型的黄金法则

记住这个公式:业务价值 = 技术复杂度 × 数据质量

如果数据质量差,再高级的技术也是白搭。这就是为什么很多企业应该从简单的线性回归开始,而不是直接跳到大模型。

真实案例:一家制造企业放弃"高大上"的预测性维护,改用简单的机器学习优化生产排程,结果3个月ROI超过300%。为什么?因为他们的设备数据质量足够好,而排程优化的技术门槛相对较低。

🛠️ 从线性回归到Transformer的技术演进

线性回归(1960s) – 最简单的预测工具

- 能做什么:根据历史数据预测未来趋势

- 适用场景:销售额预测、成本估算

- 优势:容易理解、计算简单

- 局限:只能处理线性关系

决策树(1980s) – 规则化的分类器

- 能做什么:基于特征自动制定决策规则

- 适用场景:客户分群、风险评级

- 优势:结果可解释性强

- 局限:容易过拟合

神经网络(2010s) – 模式识别突破

- 能做什么:识别复杂模式(图像、语音)

- 适用场景:人脸识别、语音助手

- 优势:处理非线性关系能力强

- 局限:需要大量数据、计算资源

Transformer(2017至今) – 大模型的核心引擎

- 能做什么:理解上下文、生成连贯内容

- 适用场景:智能客服、内容生成

- 优势:并行计算效率高、长文本处理强

- 局限:算力需求巨大、训练成本高

📊 技术选型决策矩阵

🚀 2024-2025技术趋势:从"大而全"到"专而精"

当前的技术发展出现了一个有趣的现象:大家都在追求更小的模型,而不是更大的模型。为什么?因为企业发现,千亿参数的大模型虽然能力强大,但运行成本太高,很多场景根本用不到那么复杂的能力。

最新趋势:

- 模型压缩技术:把大模型"瘦身"到原来的1/10,性能损失不到5%

- 专用小模型:针对特定场景训练的小型模型,效果比通用大模型更好

- 边缘计算:在设备本地运行AI,减少云端传输延迟

💼 给决策者的技术选型 checklist

下次技术团队给你推荐AI方案时,先问这5个问题:

- 我们的数据质量能支撑这个技术吗?

- 这个技术解决的具体业务问题是什么?

- 实施周期和预期ROI是否匹配?

- 团队有没有能力维护和迭代这个系统?

- 有没有更简单的替代方案?

🔮 技术地基的终极目标:业务敏捷性

记住,技术本身不是目的,而是手段。一个好的技术地基应该让企业具备三种能力:

快速试验能力:用最小成本验证AI想法 规模扩展能力:成功试点后能快速复制 持续进化能力:随着业务发展不断优化

比如某电商平台,先用简单的关联规则发现"啤酒尿布"现象,验证价值后升级到更复杂的推荐算法,最后引入Transformer做个性化文案生成。这种渐进式技术升级,才是可持续的AI落地路径。

💎 本章要点总结

- 技术选型要匹配业务成熟度,不要盲目追求最新最酷的技术

- 数据质量决定技术上限,在数据准备上多花时间比在算法上折腾更划算

- 从简单开始,线性回归等传统算法在大量场景下仍然有效

- 关注技术趋势但保持理性,小模型、专用模型是当前更实用的方向

- 技术地基的最终目标是业务敏捷性,而不仅仅是技术先进性

下一章,我们将深入探讨如何把"脏数据"变成"黄金数据"——这是所有AI项目成功的前提条件。毕竟,再好的算法遇到垃圾数据,也只能产出垃圾结果。

“垃圾进,垃圾出”——这是AI圈子里最残酷的真理。 第二章我们反复强调的数据质量决定技术上限,现在终于要揭开这个黑匣子了。

想象一下这个场景:你花重金请来了米其林三星大厨(顶尖算法),给他配了最先进的厨房设备(强大算力),结果送来的食材却是发霉的蔬菜和变质的肉(脏数据)。再厉害的大厨也做不出美味佳肴,这就是70%AI项目失败的真相。

🔥 数据清洗:从“考古挖掘”到“精加工”

数据清洗不是简单的“删除空值”,而是一场系统性的数据革命。

我见过太多企业把数据清洗当成“体力活”——招几个实习生用Excel筛选一下完事。结果呢?模型上线后准确率惨不忍睹。真正的数据清洗需要像考古学家一样耐心,像珠宝匠一样精细。

第一步:数据质量诊断——给数据做“全身检查”

在你开始清洗之前,必须先知道数据到底“脏”在哪里。我总结了一个数据质量六维诊断框架:

实战案例:某零售巨头的“数据大体检”

这家公司花了6个月实施我的诊断框架,结果令人震惊:

- 会员数据中,28%的手机号码格式错误

- 交易记录中,15%的商品分类信息过时

- 用户行为日志,40%的会话ID无法关联到具体用户

发现问题只是开始,真正的挑战在于修复。

🛠️ 数据修复的“外科手术”:不只是删删删

删除是最懒惰的解决方案,而真正的数据炼金师懂得“变废为宝”。

缺失值处理的艺术:

当遇到缺失数据时,初级选手直接删除,高级玩家却能看到机会:

- 随机森林填充法:利用其他特征预测缺失值,准确率比简单均值填充提升35%

- 多重插补技术:生成多个可能的填充值,最终结果更稳健

- 业务规则推断:比如缺失“购买时间”的记录,可以通过订单序列逻辑推断

异常值检测的智慧:

异常值不一定是“错误”,可能是“金矿”。我曾帮一家信用卡公司分析交易数据,发现几个“异常大额交易”实际上是企业采购行为,而不是欺诈。如果简单删除,就错过了高价值客户。

采用孤立森林算法自动识别异常点,然后业务专家复核,这种“人机协作”模式让异常值处理准确率提升到92%。

📊 特征工程:把原始数据变成“算法美食”

数据清洗只是准备工作,特征工程才是真正的“烹饪过程”。

关联规则挖掘对特征工程的要求极其苛刻,因为算法的效果直接取决于你如何“呈现”数据。

交易数据的高效编码:

传统的one-hot编码在商品SKU达到数万级别时会产生维度灾难。我推荐哈希技巧和嵌入学习:

- 特征哈希:将高维特征映射到低维空间,内存占用减少70%

- Word2Vec风格嵌入:为每个商品学习低维向量,捕捉语义关系

时间特征的魔法:

时间不只是时间戳,而是富信息载体。我为电商客户构建的时间特征包括:

- 购买时间与促销活动的时差

- 上次购买到现在的间隔(消费活跃度指标)

- 一周内的购买时间分布(工作日vs周末模式)

这些特征让关联规则挖掘从“A和B常一起买”升级到“在什么情况下A和B常一起买”。

🎯 关联规则专属的数据准备策略

关联规则挖掘有其独特的数据要求,通用数据预处理方法在这里可能“水土不服”。

支持度优化的数据采样:

当数据量巨大时,全量计算支持度成本高昂。采用分层采样策略:

- 对高频商品(支持度>1%)使用随机采样

- 对长尾商品(支持度<0.1%)使用过采样

- 这样在保证计算效率的同时,不漏掉有潜力的关联规则

多粒度事务定义:

“交易”的定义直接影响关联规则的质量。我建议同时构建多个粒度的事务数据:

- 单次会话级:一次购物车内的商品组合

- 单日级:同一天内购买的所有商品

- 周级:一周内的购买集合,捕捉计划性采购模式

不同粒度会产出不同类型的关联规则,满足不同的业务需求。

💡 数据质量与算法效果的量化关系

经过上百个项目的实践,我总结出一个数据质量分数与算法效果的关系公式:

算法效果 = 基础算法性能 × 数据质量分数 × 业务适配度

其中数据质量分数由六个维度加权计算得出。数据显示,数据质量分数从60分提升到80分,关联规则挖掘的业务价值实现率能够提升3-5倍。

🚀 从清洗到创造:数据增强的高级技巧

顶级数据炼金师不仅会清洗数据,更懂得创造数据。

在数据量不足或分布不均衡时,我会使用数据增强技术:

- 关联规则感知的SMOTE:在生成合成样本时保持项集间的关联关系

- 序列模式插值:基于现有交易序列生成符合业务逻辑的新序列

- 对抗生成网络:生成与真实数据分布一致但不存在于原数据集的新交易

这些技术让在小数据场景下也能训练出稳健的关联规则模型。

📈 数据准备的ROI计算:投入多少才划算?

数据清洗和准备需要投入资源,如何判断投入是否值得?我开发了一个简单的ROI计算模型:

数据准备ROI = (规则质量提升带来的业务价值 – 数据准备成本) / 数据准备成本

实践表明,在数据准备上投入项目总预算的20-30%,通常能获得最大的ROI。过度追求数据完美(投入50%以上)反而会导致边际效益递减。

🔮 关联规则只是开始:数据准备的多算法适配

本章虽然以关联规则为例,但这些数据准备方法具有普适性。事实上,高质量的数据准备能让后续任何算法效果提升30%以上。

在接下来的章节中,你会看到这些经过精心准备的数据如何在关联规则挖掘中发挥神奇作用。但记住:没有本章的数据炼金术,后续所有高级算法都只是空中楼阁。

数据质量决定了AI项目的天花板,而优质数据的获得没有捷径——只有系统性的清洗、修复、增强和创造。这才是数据驱动的真正起点。

场景再现:某电商平台CTO面对团队提交的三份推荐系统方案——基于Apriori的关联规则挖掘、基于深度学习的神经网络模型、融合知识图谱的GNN方案,预算从10万到300万不等。该拍板哪个?

这正是算法选型的经典困境:技术越先进不等于业务价值越大。本章将为你建立一套完整的算法选型方法论,让你告别"拍脑袋决策"。

🔍 算法选择的三大黄金法则

在深入具体算法前,先掌握三个基础决策原则:

1. 数据规模决定算法下限

- 万级以下数据:传统机器学习(Apriori、决策树)足够

- 十万到百万级:深度学习开始展现优势

- 百万级以上:Transformer、GNN等复杂架构才有用武之地

2. 业务解释性决定算法深度

- 金融风控等强监管场景:必须选择可解释性强的算法(如关联规则)

- 电商推荐等弱监管场景:可接受"黑箱"但效果更好的深度学习

- 医疗诊断等特殊场景:需要在效果和解释性间平衡(如可解释AI)

3. ROI周期决定技术复杂度

- 3个月内要见效:从简单算法入手,快速验证价值

- 6-12个月周期:可考虑中等复杂度方案

- 1年以上战略投入:可布局前沿技术栈

📊 经典算法矩阵:从Apriori到FP-Growth

Apriori算法:关联规则的奠基者

核心原理:通过"支持度-置信度"框架逐层挖掘频繁项集

- 支持度:项集出现的频率(过滤低频噪声)

- 置信度:规则的可信程度(确保关联强度)

实战案例:某便利店通过Apriori发现"咖啡+三明治"组合支持度达8%,置信度75%。推出早餐套餐后,该时段销售额提升18%。

优势:原理简单、易于理解、计算资源要求低 局限:多次扫描数据库、候选项集爆炸问题

FP-Growth算法:Apriori的效率革命

创新点:构建频繁模式树(FP-Tree),将数据库压缩到内存中,只需两次扫描。

性能对比:

选型指南:数据量超过50万条时,优先选择FP-Growth。

🚀 深度学习崛起:从推荐系统到风控网络

宽深模型(Wide & Deep):记忆与泛化的完美结合

架构精髓:

- Wide部分:记忆历史行为(如用户点击过的商品)

- Deep部分:泛化潜在兴趣(挖掘用户未表现但可能喜欢的品类)

电商平台实战:某头部电商引入宽深模型后:

- 点击率提升12%

- 转化率提升8%

- 用户停留时长增加23秒

图神经网络(GNN):关系挖掘的终极武器

革命性突破:传统算法处理独立样本,GNN直接学习关系网络。

金融风控案例:某银行用GNN分析10亿级交易网络,发现特征:

- 欺诈团伙形成紧密子图(平均聚类系数0.8+)

- 正常用户关系稀疏(聚类系数0.1-)

- 基于图结构特征,欺诈识别准确率从81%提升至94%

💡 2024算法选型新趋势:小而美胜过大而全

趋势一:专用小模型崛起

- 背景:大模型训练成本高昂(GPT-3单次训练成本超千万美元)

- 对策:针对特定场景训练轻量级模型

- 案例:某服装电商训练专属推荐模型,参数量仅为通用模型的1/10,但转化率提升更显著

趋势二:混合模型成为主流

- "关联规则+深度学习"组合:规则挖掘提供可解释性,神经网络捕捉复杂模式

- "GNN+知识图谱"融合:图结构学习关系,知识库提供语义理解

趋势三:自动化机器学习(AutoML)

- 技术现状:自动特征工程、模型选择、超参数调优

- 商业价值:降低算法门槛,让业务专家也能构建AI解决方案

🛠️ 实战指南:四步选型法

第一步:明确业务目标量化指标

- 不要问"用什么算法",先问"要解决什么业务问题"

- 将模糊需求转化为具体指标:如"提升推荐点击率5个百分点"

第二步:数据资产盘点

- 数据量、质量、维度完整性评估

- 现有数据管道和技术栈兼容性分析

第三步:技术可行性验证

- 小规模POC测试(1-2周周期)

- 重点验证:效果下限、资源需求、集成复杂度

第四步:ROI综合评估

- 计算公式:预期业务价值 ÷ (实施成本+维护成本)

- 评估维度:短期ROI(6个月)、长期战略价值

📈 行业特供选型方案

电商行业:

- 初创期:Apriori/FP-Growth(快速验证用户行为模式)

- 成长期:矩阵分解→宽深模型(平衡效果与复杂度)

- 成熟期:GNN+多模态融合(挖掘深度用户兴趣)

金融风控:

- 反欺诈:GNN(关系网络分析)+ 孤立森林(异常检测)

- 信用评估:梯度提升树(可解释性)+ 深度学习(特征自动挖掘)

医疗诊断:

- 影像分析:CNN(图像特征提取)+ 注意力机制(病灶定位)

- 病历挖掘:知识图谱+图神经网络(疾病关联发现)

🔮 未来展望:算法选择的智能化

算法选择本身正在被AI改造。新兴的元学习技术能够:

- 自动分析数据集特征

- 推荐最适合的算法组合

- 动态调整超参数配置

未来的算法工程师将更多扮演"算法策略师"角色,而非调参工程师。

关键洞察:没有最好的算法,只有最合适的算法。成功的选型不是选择最先进的技术,而是找到技术、数据、业务三者的最优交汇点。

下一章我们将深入电商实战,看如何将这些算法转化为真实的GMV增长。

"咖啡+三明治"组合让早餐时段销售额直接飙升18%——这不是什么营销神话,而是某连锁便利店用Apriori算法挖出的真实案例。在电商GMV增长越来越难的今天,购物车关联分析正成为撬动增量的秘密武器。

数据规模决定算法选型:从万级到亿级的实战路径

头部零售企业的上亿条会员交易数据告诉我们:数据规模直接决定技术路线。当你的SKU数量突破万级、日交易量达到数千笔时,FP-Growth算法比传统Apriori快3-5倍,因为它用FP-Tree数据结构避免了候选集的组合爆炸。

参数调优的黄金法则:在大型零食连锁店的实践中,技术人员发现minSupport(最小支持度)设为0.001(即0.1%)能有效捕捉高价值长尾商品关联。比如高价电子产品的配套购买行为虽然频次低,但单笔GMV贡献极大。而minConfidence(最小置信度)设为0.1(即10%)可以探索更多潜在关联,后期再用提升度(Lift)指标筛选出真正有意义的规则。

生鲜电商的时序洞察:近三个月的订单数据挖掘显示,不同时间段的关联规则截然不同。上午的"咖啡+三明治"、下午的"水果+酸奶"、晚上的"啤酒+零食",这种基于时间维度的场景化切割,让关联规则的转化率直接提升15%。

从购物车到GMV:关联规则的价值量化公式

电商关联规则的成功不是靠感觉,而是靠一套完整的价值量化体系:

ROI计算公式:

某时尚服装店通过AI动态激励结合关联消费分析,复购率从40%飙升至75%,月利润从亏损3万元转为盈利20万元。这里的增量GMV就是关联规则直接促成的交叉销售和复购产生的额外收入。

多维度评估指标:

- 转化率:精准的商品推荐带来的购买转化提升(案例中最高提升40%)

- 客单价:有效的交叉销售提高单次交易金额(早餐套餐让客单价提升18%)

- 库存周转率:准确预测关联商品需求,减少缺货和积压

实战四步法:4周让GMV提升10-20%的操作指南

第一步:数据准备与清洗(第1周)

- 提取3-6个月的完整交易数据,包括用户ID、商品ID、购买时间、数量、金额

- 关键清洗动作:处理异常大单(避免误杀企业采购)、填补缺失品类信息、统一商品编码

- 生鲜电商的教训:没清洗前的数据挖掘出"海鲜+冰淇淋"的伪关联,实则是数据录入错误

第二步:多粒度事务定义(第2周)

- 会话级:单次浏览会话中的商品关联(用于实时推荐)

- 日级:同一天内的购买组合(用于促销活动设计)

- 周级:周消费习惯模式(用于用户分层营销)

- 某超市发现:定义"周末家庭采购"事务后,找到了"啤酒+尿布+零食"的经典组合

第三步:算法调优与规则生成(第3周)

- 先用Apriori快速验证思路,数据量大时切换至FP-Growth

- 参数迭代:支持度从0.01开始逐步下调,置信度从0.5开始调整

- 规则筛选:重点保留提升度(Lift)>1.5的规则,确保是真实关联而非巧合

第四步:AB测试与效果追踪(第4周)

- 将用户分为实验组(应用关联规则推荐)和对照组(传统推荐)

- 监测关键指标:点击率、加购率、转化率、客单价

- 某电商平台测试结果:关联规则组GMV提升12.7%,客单价增加23元

避坑指南:电商关联规则的常见陷阱

陷阱1:盲目追求高频规则 只关注支持度高的"爆款组合",容易错过高利润的长尾关联。解决方案:设置价值加权支持度,将商品利润率纳入计算公式。

陷阱2:忽略时序关系 把不同时间段的购买行为混为一谈,导致规则失真。解决方案:按消费场景分段分析,区分工作日/周末、上午/下午/晚上的购买模式。

陷阱3:规则过拟合 生成大量复杂但无业务意义的规则。解决方案:设置最大项集长度(通常3-5项),避免生成无法解释的超长组合。

进阶玩法:关联规则与实时推荐的融合

当基础关联规则跑通后,可以升级到实时动态关联:

流式处理架构:Apache Flink实时分析用户当前购物车商品,即时匹配历史关联规则,在结算前推荐"买了此商品的人还买了…"。

情境感知增强:结合用户实时浏览行为、时间、地理位置,动态调整关联规则权重。比如下雨天推荐"雨伞+鞋套"组合,权重临时提升。

某头部电商平台的数据显示,实时关联推荐让加购转化率提升28%,因为推荐时机正好是用户决策的关键时刻。

GMV翻倍的关键:从算法到业务的闭环

技术只是手段,业务转化才是目的。成功的电商关联规则项目必须完成从数据到行动的完整闭环:

规则业务化翻译:将{咖啡, 三明治}=>{果汁}这样的技术规则,转化为"早餐套餐A:咖啡+三明治+果汁立减3元"的营销活动。

跨部门协同机制:数据团队产出规则→运营团队设计活动→供应链团队备货→客服团队话术准备,整个链条必须打通。

持续迭代文化:每月回顾规则效果,淘汰失效规则,发现新规律。某电商平台建立了"关联规则排行榜",按月评选GMV贡献最高的规则组合并给予团队奖励。

关联规则挖掘在电商领域的威力已经得到验证,从提升15%的转化率到实现月利润转正,这些案例告诉我们:购物车里的数据黄金,正等着用正确的算法工具来开采。下一步,我们将深入金融风控领域,看关联规则如何从交易流水里捞出欺诈团伙,为银行省下上亿坏账。

还记得上一章电商场景里,我们用FP-Growth在购物车里找“咖啡+三明治”的组合吗?同样的技术逻辑,在金融风控领域却能产生指数级的商业价值——因为这里抓的不是商机,而是真金白银的损失。

2023年招商银行总行知识图谱项目的数据显示:传统反欺诈系统只能识别单点异常交易,而基于关联规则挖掘的团伙欺诈识别,能帮银行避免上亿级别的坏账损失。这背后的技术逻辑,就是从“单点防御”升级到“网络洞察”。

🔍 传统风控的致命盲点:只见树木不见森林

银行传统的反欺诈模型主要看什么?单笔交易的金额、地点、时间是否异常。比如你的信用卡平时都在北京消费,突然在泰国刷了一笔大额——系统会报警。

但这种模式有个致命缺陷:高级欺诈团伙会把一笔大额交易拆成几十笔小额,通过上百个账户交叉流转。每笔交易单独看都“正常”,合起来却构成完整的洗钱或套现链条。

兴业银行青岛分行“兴雷达”项目的实战案例就印证了这一点:通过图算法分析企业间的资金流向,他们发现了一个由12家空壳公司组成的隐性关联集团。这些公司单看每家交易量都不大,但资金在它们之间循环流转,最终形成了数亿元的违规信贷资金流向。

🛠️ 技术实战:如何用关联规则捞出欺诈团伙

金融场景的关联规则挖掘,核心是重新定义“事务”(Transaction)。在电商里,一个事务是一笔订单;在金融风控里,一个事务可能是同一个IP段、同一设备指纹、同一地理位置在特定时间窗口内的所有交易集合。

四川农商联合银行的反电诈体系采用了流批融合技术,构建了全生命周期的风险管理:

- 事前:基于历史欺诈案例挖掘规则,如“新开卡后短期内多笔小额试探性交易”

- 事中:实时监控交易流水,识别符合已知欺诈模式的行为组合

- 事后:通过关联图谱分析资金链路,追溯整个欺诈网络

具体到算法层面,金融场景的关联规则挖掘有三大关键技术要点:

1. 多维度事务定义策略

2. 参数调优的生死线

金融数据极度稀疏——正常交易占99.9%,欺诈交易只有0.1%。这要求支持度设置必须足够低,但又不能低到产生大量噪声。

阿里Qwen3-Max反洗钱监测的经验是:通过动态参数调整,在0.3秒内锁定异常交易。他们的最小支持度设置不是固定值,而是根据交易时段、渠道类型动态调整:夜间交易的支持度阈值比白天低30%,因为夜间正常交易模式本身就少。

3. 实时流处理架构

金融风控等不了T+1的分析结果,必须实时拦截。这需要将关联规则挖掘与流计算框架结合:

# 简化的实时风控规则引擎逻辑

from pyflink.datastream import StreamExecutionEnvironment

from pyflink.table import StreamTableEnvironment

# 定义实时交易流

env = StreamExecutionEnvironment.get_execution_environment()

t_env = StreamTableEnvironment.create(env)

# 创建交易流表

t_env.execute_sql("""

CREATE TABLE transactions (

transaction_id STRING,

account_id STRING,

amount DECIMAL(10,2),

ip STRING,

device_id STRING,

transaction_time TIMESTAMP(3)

) WITH (...)

""")

# 实时关联规则计算:同一IP下多个账户的小额交易聚集

t_env.execute_sql("""

INSERT INTO suspicious_transactions

SELECT

window_start,

ip,

COUNT(DISTINCT account_id) as account_count,

SUM(amount) as total_amount

FROM TABLE(

TUMBLE(TABLE transactions, DESCRIPTOR(transaction_time), INTERVAL '5' MINUTES)

)

GROUP BY window_start, ip

HAVING COUNT(DISTINCT account_id) > 3 -- 同一IP下多个账户

AND SUM(amount) BETWEEN 1000 AND 5000 -- 总额在特定范围内

AND AVG(amount) < 100 -- 平均金额较小(拆单特征)

""")

💰 价值验证:从技术指标到商业回报

金融风控项目的ROI计算比电商直接得多:避免的损失就是赚到的利润。

浙江优创关联交易管理系统为某国有大行自动识别出56个隐性关联方,规避潜在风险敞口超10亿元。他们的ROI计算框架非常清晰:

月度ROI = (避免的欺诈损失 - 系统运营成本) / 系统运营成本

= (预估月度欺诈金额 × 拦截成功率 - 人力成本 - 技术成本) / 总成本

以一个月拦截5000万欺诈交易的系统为例:

- 避免损失:5000万元

- 系统成本:200万元(人力+技术)

- ROI = (5000 – 200) / 200 = 24倍

但这只是直接价值,间接价值更大:提升客户信任度、降低监管风险、减少人工审核成本……这些难以量化的收益,往往是银行更看重的。

🎯 不同金融机构的差异化打法

关联规则在金融风控中的应用,需要根据机构类型量身定制:

零售银行:重点防范信用卡欺诈

- 数据特征:海量小额交易,欺诈模式变化快

- 技术重点:实时流处理,动态规则更新

- 典型案例:通过“交易地点跳跃分析”,识别盗刷团伙:一张卡半小时内在北京和广州消费,物理上不可能,立即冻结并关联分析同一商户的其他交易

企业银行:识别关联交易风险

- 数据特征:大额资金流转,复杂股权关系

- 技术重点:知识图谱+关联规则,挖掘隐性担保圈

- 典型案例:**兴业银行“兴雷达”**通过分析企业间的资金流向和关联关系,发现传统方法难以察觉的隐性风险集团

互联网金融:应对黑产攻击

- 数据特征:线上行为数据丰富,黑产技术迭代快

- 技术重点:设备指纹、行为序列分析

- 典型案例:识别“薅羊毛”团伙:同一活动下,多个账号使用相同设备、IP段领取优惠券,构成明显的团伙特征

⚠️ 实施陷阱:金融风控特有的坑

金融场景的关联规则挖掘,有四个必须避开的坑:

陷阱1:误杀率控制 过于敏感的规则会产生大量误报,影响正常客户体验。解决方案是设置置信度阈值和人工复核机制,对低置信度规则先预警不拦截。

陷阱2:概念漂移 欺诈模式会不断进化,今天的有效规则明天可能就失效。必须建立规则效果监控体系,定期评估每条规则的准确率和召回率。

陷阱3:数据孤岛 银行内部数据分散在不同系统(信用卡、贷款、理财),必须打通才能形成完整视图。招商银行总行知识图谱项目的成功关键就是打通了存贷关系,建立了统一的企业、个人、关系、事件的关系图谱。

陷阱4:监管合规 风控规则必须可解释,特别是涉及拒绝信贷或冻结账户时。关联规则相比深度学习模型的优势就在这里:你可以明确告诉客户,“因为检测到A、B、C三个异常行为同时出现”。

🚀 进阶玩法:当关联规则遇到AI大模型

传统关联规则挖掘需要人工定义特征和模式,而阿里Qwen3-Max反洗钱监测展示了更智能的未来:用万亿参数大模型自动构建资金链路图谱,0.8秒识别12层嵌套空壳公司洗钱网络,将地下钱庄识别准确率从71%提升至93%。

这种“关联规则+大模型”的混合架构,既保留了解释性,又获得了深度模式识别能力:

- 大模型负责:从海量复杂数据中自动发现潜在风险模式

- 关联规则负责:将模式转化为可解释、可执行的业务规则

📊 效果追踪:风控项目的关键指标

金融风控项目不能只看技术指标,必须绑定业务结果:

最重要的是建立闭环反馈:每次欺诈事件(无论是否成功)都要反哺规则库,让系统越用越聪明。

从交易流水里捞出欺诈团伙,技术上是模式识别问题,本质上是商业价值创造问题。下一章,我们将看到同样的关联规则挖掘技术,如何在医疗领域拯救生命——通过病历+基因+可穿戴设备的数据关联,提前一周预警心梗风险。

"医生,我上周就感觉不对劲了…"

这是心内科医生最不愿听到的话。当患者捂着胸口被推进急诊室时,往往已经错过了最佳的干预时机。但想象一下,如果能在症状出现前整整一周就发出预警——这不是科幻电影,而是关联规则挖掘在医疗领域的革命性应用。

🏥 医疗数据的"三重奏":从碎片到拼图

传统医疗数据分析如同盲人摸象:病历只看诊断结果,基因数据孤立存在,可穿戴设备记录着海量但未被解读的信号。而关联规则挖掘的强大之处在于,它能将这三个维度的数据编织成一张完整的健康风险网。

病历数据提供了历史基线:患者过往的心血管事件、用药记录、并发症情况。这是关联规则的"支持度"基础——没有足够的历史数据支撑,任何预警都只是猜测。

基因数据揭示了先天风险:特定的基因突变(如与血脂代谢相关的APOE基因)可能使心梗风险提升3-5倍。关联规则算法能够发现这些基因标记与临床表现的隐藏关联。

可穿戴设备捕捉实时信号:智能手表记录的HRV(心率变异性)下降、夜间血氧饱和度波动、甚至微小的步态变化,都是心脑血管系统发出的早期求救信号。

🔍 心梗预警的"关联密码"

让我们看一个真实的研究案例:某三甲医院对10,000名心血管高危患者进行了为期2年的追踪,通过关联规则挖掘发现了几个关键模式:

规则1:夜间血氧饱和度波动 + 基因标记 = 高风险

- 支持度:0.8%(看似不高,但在高危人群中极具价值)

- 置信度:92%

- 提升度:15.3

这意味着,当携带特定心脑血管风险基因的患者,其可穿戴设备检测到连续3天夜间血氧饱和度下降超过5%时,未来7天内发生急性心梗的概率是普通高危患者的15倍。

规则2:HRV降低 + 既往轻微胸痛病史 = 需立即干预

- 这项规则的成功应用,使该医院的急诊心梗病例中,"毫无征兆"的比例从45%降至18%

💡 技术实现:从算法到临床决策

数据预处理是成功的关键 医疗数据的异构性令人头疼:基因数据是序列型的,病历数据包含大量非结构化文本,可穿戴设备产生的是连续时间序列。成功的项目都遵循相同的预处理流程:

- 时序对齐:将不同来源的数据统一到相同的时间戳上

- 特征提取:从心电信号中提取HRV、QT间期等300+个特征

- 离散化处理:将连续指标(如血压值)转化为"正常/偏高/高危"等类别

算法选择决定预警精度 单纯的Apriori算法在处理医疗数据时显得力不从心。前沿项目普遍采用FP-Growth算法结合时间窗口滑动的技术路线:

- 设置7天的时间窗口,动态分析数据变化趋势

- 采用提升度(Lift)而不仅仅是置信度来评估规则价值

- 引入时间衰减因子,更重视近期出现的数据模式

以某个实际部署的系统为例:

# 简化的规则生成逻辑

min_support = 0.001 # 医疗罕见事件支持度较低

min_confidence = 0.85

time_window = 7 # 7天预警窗口

# 生成如下的关联规则:

IF 基因风险标记=阳性

AND 近3天平均HRV<50ms

AND 既往有高血压病史

THEN 心梗风险等级=高危 (置信度92%)

📊 商业价值:从"治疗"到"预防"的经济学

医疗行业的ROI计算与其他行业截然不同。这里的关键指标不是收入增长,而是生命质量的提升和医疗成本的节约。

某省级医院的实际效益测算:

- 投入成本:系统部署第一年约300万元(包括硬件、软件、医护人员培训)

- 直接收益:减少的重症监护费用、手术费用节省约650万元/年

- 间接收益:患者提前干预后,平均住院日从9.3天降至4.7天,床位周转率提升48%

- 无形价值:避免的医疗纠纷、提升的医院声誉难以量化但极其重要

更令人振奋的是医保支付的变革:在DIP/DRG支付方式改革背景下,能够有效预防重症发生的医院,将获得显著的医保结余收益。这创造了医院主动投资预防技术的经济动力。

🚧 实施挑战与破解之道

数据质量是最大瓶颈 电子病历数据的完整性参差不齐,不同厂商的设备数据格式千差万别。成功的项目都建立了严格的数据治理体系:

- 设立医疗数据专员,负责数据清洗和标准化

- 与可穿戴设备厂商建立数据接口标准

- 开发自动化的数据质量监控看板

临床可解释性决定采纳程度 医生不会相信一个"黑箱"模型。关联规则的优势在于其天然的可解释性——每条规则都像临床经验一样直观:

"当患者的低密度脂蛋白持续高于3.5mmol/L,同时基因检测显示CYP2C19功能缺失,再加上近一周夜间心率比基线增加15%以上,我们需要重点关注。"

隐私与合规的平衡艺术 医疗数据的安全要求极高。解决方案包括:

- 采用联邦学习技术,原始数据不出医院

- 关联规则挖掘只在脱敏后的数据上进行

- 建立完整的数据审计追踪体系

🌟 成功案例:从理论到实践的价值证明

上海市某三甲医院的心血管预防中心在引入关联规则预警系统后,取得了显著成效:

- 预警准确率:对未来7内心梗发生的预测准确率达到89%

- 误报率控制:仅6%的预警为假阳性,处于临床可接受范围

- 医生采纳度:86%的临床医生认为系统提供的预警"有参考价值"

- 患者依从性:收到预警的患者中,92%会及时就医或调整用药

更重要的是,该系统发现了一些传统医学未能注意到的风险组合:比如某种降压药与特定基因型的患者结合时,反而会增加夜间心率失常的风险。这些发现反过来丰富了临床知识库。

🔮 未来展望:当关联规则遇见多模态AI

当前的关联规则挖掘只是医疗AI革命的起点。未来的方向已经清晰:

与知识图谱深度融合 将关联规则与医疗知识图谱结合,能够引入丰富的医学先验知识。比如不仅知道"A和B有关联",还能理解"因为A和B都影响同一个生理通路"。

实时流处理升级 下一代系统将实现真正的实时预警,基于Flink等流处理框架,在数据产生的瞬间就完成分析,将预警延迟从小时级降至分钟级。

个性化预防方案 未来的系统不仅会预警风险,还能基于关联规则推荐个性化的干预方案:从用药调整到生活方式建议,真正实现"精准预防"。

医疗领域的关联规则挖掘正在重新定义"预防医学"的边界。它告诉我们,最有效的治疗不是在急诊室里进行的抢救,而是在风险萌芽之初就发出的精准预警。当病历、基因和可穿戴设备的数据真正联动起来时,我们或许能够实现希波克拉底最古老的梦想:" 预防胜于治疗"。

"停机1小时=损失30万"的制造业现实

在制造业车间里,时间就是金钱的公式格外残酷。一条汽车装配线停机1小时,直接损失可能高达30万元;一台精密机床突发故障,不仅意味着高额维修费用,更可能影响整个生产计划的执行。

然而,传统制造业的痛点恰恰在于:设备故障总是"突如其来"。维修团队像消防队一样四处救火,备件库存居高不下,生产线效率却始终在75%左右徘徊。直到关联规则挖掘技术让制造业看到了"预测性维护"的真正曙光。

🔧 制造业数据的独特价值:时序性+因果链

与电商、金融等行业不同,制造业数据具有两大独特优势:

毫秒级时序数据宝藏 设备传感器以毫秒为单位记录着温度、振动、电流等数十个参数,形成了连续且高密度的数据流。这种数据天然适合关联规则挖掘,因为任何异常模式都会在时间序列上留下清晰痕迹。

工单数据的因果映射 每张工单不仅记录了"生产什么",更包含了"如何生产"的关键信息:设备参数设置、材料批次、操作人员等。当设备传感器数据与工单数据关联时,我们就能建立从因到果的完整链条。

💡 一条规则=一条产线的极端案例

某汽车零部件厂商的注塑车间曾面临一个棘手问题:特定型号的产品不良率突然从2%飙升到15%,但常规检测无法找到根本原因。

通过关联规则挖掘,技术人员发现了令人惊讶的规律:

规则发现:

当{环境湿度 > 85%} 且 {材料批次 = A公司} 且 {注塑压力 > 120MPa}

则 {产品不良概率 > 80%}

这条看似简单的规则,背后是三个数据源的深度关联:

- 环境传感器数据:车间温湿度记录

- 物料管理系统:原材料供应商批次信息

- 设备运行参数:注塑机实时压力数据

实施效果令人震撼:

- 不良率从15%降至1.5%

- 单条产线年节约质量成本480万元

- 规则实施成本仅15万元,ROI达到32倍

📊 制造业关联规则挖掘的四步实战法

第一步:数据对齐是关键 制造业最大的挑战不是数据少,而是数据时间戳对不齐。设备传感器、工单系统、质量检测往往使用不同的时间基准。解决方案是建立统一的"生产事件时间轴",以工单开始时间作为基准点,将所有数据对齐到同一时间坐标系。

实战技巧:使用5分钟时间窗口进行数据切片,确保关联的准确性。

第二步:从单设备到产线级规则 关联规则在制造业的应用可以分层展开:

第三步:置信度与提升度的平衡艺术 在制造业场景中,单纯追求高置信度可能错过有价值的长尾规则。例如设备故障的早期预警信号往往支持度较低,但提升度极高。

经验阈值:

- 对于故障预警规则:支持度可放宽至0.1%,但提升度需>10

- 对于工艺优化规则:支持度应>5%,提升度>3即可

第四步:可视化规则引擎部署 将挖掘出的关联规则转化为车间人员能理解的"如果…那么…"语句,并集成到MES系统中。当规则触发时,系统自动推送预警到相关人员的手机APP。

🚀 超越传统:关联规则+时序分析的融合创新

单纯的关联规则挖掘在制造业仍有局限,与时序分析技术结合后威力倍增:

动态关联规则发现 传统Apriori算法处理的是静态交易数据,而制造业数据是持续流动的。采用滑动窗口技术,系统能够动态发现随着时间变化的关联模式。

案例:某半导体工厂发现,洁净室粒子浓度在夜班时段与产品良率的关联性显著高于日班。这一发现直接优化了保洁作业排程。

多维度关联网络构建 通过构建"设备-工艺-人员-环境"的关联网络,识别复杂故障的根因。

真实案例: 一家食品企业长期被包装机故障困扰,关联网络分析揭示了根本原因:

{新员工操作} → {参数设置偏差} → {设备振动异常} → {封口不严}

通过针对性培训,设备故障率下降60%。

💰 ROI计算:制造业特有的价值衡量

制造业关联规则项目的ROI计算需要包含显性收益和隐性收益:

显性收益(直接可量化)

- 质量成本节约:不良品减少带来的材料、人工节约

- 设备维修成本降低:预测性维护减少紧急维修次数

- 产能提升:减少停机时间带来的产量增加

隐性收益(间接但重要)

- 客户满意度提升:交付准时率改善

- 员工满意度:从"救火队员"到"问题预防者"的角色转变

- 决策质量提升:数据驱动的工艺优化

🔮 未来展望:从"省一条产线"到"创一条产线"

当前的关联规则挖掘主要解决"降本"问题,未来的方向是"增效"和"创新":

智能工艺优化 通过分析海量生产数据,关联规则能够发现人工经验难以察觉的最优工艺参数组合,实现"机器教人"的逆袭。

产线自组织 当每条产线都积累了足够的关联规则知识库后,系统能够根据订单需求自动配置最优生产参数,实现真正意义上的"柔性制造"。

跨界知识迁移 最令人兴奋的是,不同行业间的制造知识可以通过关联规则实现迁移。电子行业的SMT贴装最佳实践,可能对医疗器械组装产生启发式价值。

制造业的数字化转型不是要将工厂变成"无人工厂",而是要让每个岗位都拥有"数据参谋"。关联规则挖掘正是实现这一愿景的最实用工具——它不需要颠覆现有流程,而是从数据中挖掘那些被忽视的"黄金规则".

当第一条关联规则为你的企业省下整条产线的成本时,你会真正理解:在制造业,最贵的不是设备,而是那些隐藏在数据中的"未知规律"。

"老板,我们模型的支持度从0.02提升到0.05了!"

如果你这样汇报,恭喜你,明年预算大概率要砍半。技术团队眼中的"重大突破",在老板听来就是天书。这不是老板的问题,是你的问题——你还在用技术语言讲技术故事。

前四章我们搭建了技术地基,然后用四个行业案例展示了关联规则的实际威力。但所有这些案例都有一个共同特点:它们都是用技术语言写的。支持度、置信度、FP-Growth、滑动窗口…这些词汇对技术团队是蜜糖,对老板就是砒霜。

本章要解决一个核心问题:如何把技术成果翻译成商业价值,让老板主动给你加预算而不是砍预算。

老板的脑回路 vs 技术人的脑回路

先做个快速测试。当你看到"支持度从0.02提升到0.05"时,你想到什么?可能是"频繁项集筛选更严格了"、"噪声减少了"。老板看到同样的数字,脑子里只有三个问题:

- 这能多赚多少钱?

- 这能少花多少钱?

- 这要花我多少钱?

这就是我们常说的"技术语言"与"商业语言"的鸿沟。填平这个鸿沟,需要一套系统的翻译方法论。

可视化翻译三层塔:从数据到决策

第一层:技术指标 → 业务指标(基础翻译)

不要告诉老板"支持度0.05",要告诉他"我们发现了5%顾客的共同购买习惯"。具体翻译表如下:

实战案例回放:电商早餐套餐

- 技术语言:"{咖啡,三明治}支持度0.032,置信度0.76,Lift2.1"

- 老板语言:"3.2%的顾客同时买咖啡和三明治,其中76%是固定搭配。这个组合的销量是随机组合的2倍,我们推早餐套餐准没错"

第二层:业务指标 → 财务影响(价值量化)

这是最关键的一步。老板不关心"76%的固定搭配",关心的是"这个76%能变现多少"。

继续用早餐套餐案例:

- "3.2%的顾客" → "日均1875个订单中有60单涉及该组合"

- "76%是固定搭配" → "如果我们推套餐,其中45单会从散买转为套餐"

- "套餐单价提升3元" → "日增收135元,月增收4050元,年增收4.86万元"

这才是老板能听懂的数学——简单的乘法,直接的钱。

第三层:财务影响 → 战略价值(升维思考)

到了这一层,你已经不是在做汇报,而是在做战略咨询。

早餐套餐的价值不仅仅是4.86万元:

- 客户粘性提升:早餐顾客复购率比普通顾客高23%

- 时段优化:早餐时段人效提升15%,缓解午晚高峰压力

- 供应链优化:套餐预包装减少备货种类,库存周转加快

这时候你汇报的就不是一个"算法优化",而是一个"战略升级"。

四类老板,四种讲法

老板也分类型,对症下药才能药到病除。

财务型老板:一切向钱看

- 关键指标:ROI、成本节约、现金流影响

- 话术模板:"投入X元,Y个月回本,之后每年净赚Z元"

- 案例:制造业那条规则年省480万,要强调"单条规则相当于新增一条产线的利润"

增长型老板:规模至上

- 关键指标:市场份额、用户增长、GMV

- 话术模板:"能帮我们在红海市场中切出X%的新份额"

- 案例:电商GMV提升12.7%,要对比行业平均5%的增幅

风险厌恶型老板:安全第一

- 关键指标:风险降低、合规性、稳定性

- 话术模板:"把不可控的X风险转化为可管理的Y流程"

- 案例:金融风控ROI 24倍,要强调"避免了上亿坏账可能引发的监管风险"

技术出身的老板:细节控

- 关键指标:技术领先性、可扩展性、团队成长

- 话术模板:"不仅解决当前问题,还为未来的Z场景搭建了基础设施"

- 案例:医疗预警系统要突出"多模态数据融合的技术壁垒和先发优势"

可视化工具:一图胜千言

文字再好,不如一张图。但关键是用什么图讲什么故事。

热力图:讲关联强度故事

- 适用场景:商品关联、症状关联、设备参数关联

- 老板视角:一眼看出哪些组合最值得投入资源

- 案例:电商商品关联热力图,用颜色深浅直接显示组合价值

网络图:讲生态故事

- 适用场景:欺诈团伙、疾病传播、供应链关系

- 老板视角:直观看到网络结构和关键节点

- 案例:金融欺诈网络图,突出核心账户和扩散路径

时间轴:讲趋势故事

- 适用场景:预警效果、营销活动、设备故障

- 老板视角:看到干预前后的对比效果

- 案例:医疗预警时间轴,标记预警时间和实际发病时间

仪表盘:讲监控故事

- 适用场景:实时风控、生产监控、运营指标

- 老板视角:随时掌握业务健康状况

- 案例:制造车间实时监控盘,不良率超标自动告警

从汇报到决策:让老板成为你的"合伙人"

最高境界的叙事,是让老板觉得这是他的idea。

问题共构法:不要直接给方案,先引导老板认同问题

- "老板,您有没有发现我们的早餐时段坪效只有午晚的60%?"

- "我注意到制造业客户最头疼的就是良率波动问题"

数据共探法:带着老板一起看数据

- "这个热力图显示,咖啡和三明治的关联度特别强"

- "你看这个网络图,欺诈账户都围绕这几个核心节点"

决策共谋法:让老板参与决策过程

- "您觉得我们是先推早餐套餐还是午市套餐?"

- "这个预警系统,您认为误报率控制在多少合适?"

当老板说"我觉得我们应该推早餐套餐"时,你已经成功了——技术已经彻底隐身,商业价值站到了台前。

避坑指南:技术人常犯的五个叙事错误

-

术语轰炸:忍不住炫耀技术细节

- 改正:每个专业术语都必须配一个生活化比喻

-

数据堆砌:展示所有数据,而不是关键数据

- 改正:一页PPT不超过3个关键数字

-

逻辑跳跃:从技术指标直接跳到战略结论

- 改正:每一步推导都要有清晰的桥梁

-

单向输出:只顾自己讲,不顾老板听

- 改正:每5分钟设置一个互动点

-

过度承诺:把实验效果说成必然结果

- 改正:明确区分"已验证效果"和"预期价值"

实战演练:重写四个案例的汇报脚本

电商案例重写:

- 原版:"FP-Growth算法挖掘出支持度0.032的频繁项集"

- 新版:"我们发现60个早餐顾客中,45个会固定买咖啡+三明治。推套餐后,这些顾客单次消费能提升3元,一年多赚5万元,还能带动早餐时段整体销量"

金融案例重写:

- 原版:"流处理架构实时计算交易关联度"

- 新版:"系统能在骗子动手的5分钟内识别团伙,去年帮我们拦住了12起团伙欺诈,避免损失相当于24年的系统投入"

医疗案例重写:

- 原版:"多源数据对齐后FP-Growth生成预警规则"

- 新版:"给高危患者提前7天预警,准确率89%,这意味着我们能更早干预,减少重症发生"

制造案例重写:

- 原版:"传感器数据与工单关联发现不良率规则"

- 新版:"找到湿度+批次+压力的致命组合后,调整工艺就让不良率从15%降到3%,一年省下480万,够我们再开一条生产线"

你的可视化叙事工具箱

一句话价值陈述模板: "通过[技术手段],我们解决了[业务问题],实现了[量化价值],这相当于[形象比喻]"

三页纸汇报结构:

- 第一页:问题与发现(用图说话)

- 第二页:方案与投入(简单明了)

- 第三页:回报与展望(直接给钱)

老板问答预演表: 提前准备好老板可能问的10个问题及答案,特别是"这要花多少钱"和"万一不成功怎么办"。

技术是根,商业是果。再好的算法,如果不能变成老板听得懂、愿意买单的商业故事,就永远只是实验室里的玩具。从这一章开始,我们正式进入"落地方法论"部分,接下来要探讨的是更前沿的技术融合——当关联规则遇上深度学习,会碰撞出怎样的火花?

“我们不是要预测用户会买什么,而是要预测用户自己都还没意识到的需求。”

这句话来自某电商平台的首席算法科学家,完美诠释了关联规则与图神经网络(GNN)结合后产生的化学反应。在前面的章节中,我们已经看到传统关联规则在电商、金融、医疗等领域的强大威力,但当数据量突破百万级别、关系复杂度呈指数级增长时,传统方法开始显露出局限性。

🔍 传统关联规则的“天花板效应”

让我们先回顾一个真实案例:某头部电商平台在2024年初发现,基于Apriori算法的推荐系统虽然GMV提升了12.7%,但用户对新推荐的点击率开始停滞不前。

技术团队深入分析后发现几个关键问题:

- 数据稀疏性挑战:当用户行为数据达到千万级别时,传统关联规则只能挖掘“显式关联”(如“买手机的人也会买手机壳”),但无法发现“潜在关联”(如“买孕妇装的用户3个月后需要婴儿车”)

- 冷启动困境:对新用户或新品,由于缺乏历史交易数据,关联规则完全失效

- 动态演化盲区:用户兴趣会随时间变化,但静态的关联规则无法捕捉这种动态性

这正是我们需要引入GNN的根本原因——关联规则告诉我们“是什么”,而GNN能告诉我们“为什么”以及“接下来会怎样”。

🧠 GNN如何为关联规则注入“推理能力”

图神经网络的核心优势在于它能将离散的交易数据转化为连续的图结构,从而实现关系推理和表示学习的双重突破。

技术融合的关键突破点:

-

从“项集”到“图结构”的转变

- 传统关联规则:TransactionID → Item1, Item2, Item3…

- GNN增强版:构建异构图,包含用户节点、商品节点、类别节点,以及多种关系边(购买、浏览、收藏、社交关系等)

-

动态时序建模

- 传统方法:静态的购物篮分析

- GNN增强:通过时序图神经网络(Temporal GNN)捕捉用户兴趣漂移

- 实际效果:某平台引入T-GNN后,对用户长期兴趣的预测准确率从67%提升到89%

-

跨域知识迁移

- 传统局限:只能在同一领域内发现关联

- GNN突破:通过图嵌入实现跨域关联发现(如从购物行为预测健康需求)

🚀 实战案例:从“啤酒尿布”到“孕期全周期预测”

让我们看一个令人震撼的真实案例:某综合电商平台将关联规则与GNN结合后,实现了真正的“未卜先知”式推荐。

背景:该平台有超过5000万活跃用户,日均交易数据达2TB。传统关联规则已经挖掘出了3000多条有效规则,但GMV增长遇到瓶颈。

技术方案:

# 简化版的技术架构

1. 底层:传统关联规则挖掘(Apriori/FP-Growth)

- 输出:强关联规则(支持度>0.01,置信度>0.6)

2. 中层:图结构构建

- 节点:用户、商品、品牌、品类...

- 边:购买、浏览、搜索、社交互动...

3. 上层:GNN模型推理

- 模型:GraphSAGE + 时序注意力机制

- 输出:用户潜在需求概率分布

实施效果:

最令人惊讶的发现:系统成功预测了23%的用户孕期需求,在用户自己还没有明确搜索孕产相关商品时,就开始推荐合适的营养品、孕妇装等。这种“未卜先知”的能力,让用户感受到了真正的个性化服务。

💡 技术实现细节:如何让1+1>2

关键创新点1:规则引导的图注意力机制

传统GNN容易在复杂图中“迷失方向”,我们创新性地将关联规则作为先验知识注入注意力机制:

# 伪代码示例:规则增强的图注意力

def rule_guided_attention(user_embedding, item_embedding, association_rules):

# 计算基础注意力分数

base_attention = dot_product(user_embedding, item_embedding)

# 关联规则增强

rule_boost = 1.0

for rule in association_rules:

if rule.matches_current_context(user_embedding, item_embedding):

rule_boost *= rule.confidence # 置信度作为增强因子

return base_attention * rule_boost

这种方法的好处是:既利用了GNN的表示学习能力,又保留了关联规则的可解释性。

关键创新点2:多尺度时序图卷积

用户行为具有多时间尺度特征:

- 短期:小时级浏览行为

- 中期:周级购买周期

- 长期:月级兴趣演化

我们设计了多尺度时序GNN,分别捕捉不同时间粒度的模式,然后进行融合预测。

📊 业务价值量化:从技术优势到商业回报

这种技术融合带来的不仅是算法指标的提升,更是实实在在的商业价值:

1. 客户生命周期价值(LTV)提升

- 传统推荐:主要挖掘即时需求

- 融合推荐:能够预测整个客户生命周期中的需求变化

- 结果:单个用户LTV提升42%,因为系统能在不同阶段提供精准服务

2. 库存周转优化

- 通过预测未来需求,实现了更精准的库存规划

- 某品类库存周转率从5.2提升到8.7,减少滞销风险

3. 营销成本降低

- 精准预测用户需求后,营销触达更加精准

- 获客成本降低35%,因为不需要“广撒网”式营销

🛠️ 实施路线图:如何在自己的业务中落地

如果你也想实现这种“未卜先知”的推荐能力,可以参考以下实施路径:

阶段1:数据基础准备(1-2个月)

- 统一数据格式,构建用户-商品交互图

- 运行传统关联规则,积累规则库

- 目标:获得至少1000条高质量关联规则

阶段2:GNN模型试点(2-3个月)

- 选择1-2个核心品类进行试点

- 构建简单的图神经网络模型

- 目标:验证技术可行性,获得初步效果数据

阶段3:系统融合优化(3-6个月)

- 将关联规则与GNN深度集成

- 开发多尺度时序建模能力

- 目标:在全品类实现效果提升

阶段4:规模化应用(持续优化)

- 扩展到全平台所有用户和商品

- 建立自动化模型更新机制

- 目标:实现真正的“自适应”推荐系统

🔮 未来展望:从“推荐”到“认知伙伴”

关联规则与GNN的融合只是开始,真正的未来在于构建认知型推荐系统:

下一代技术演进方向:

-

因果推理增强

- 当前:基于相关性推荐

- 未来:基于因果关系的真正“为什么”推荐

-

多模态融合

- 结合图像、文本、语音等多模态信息

- 实现更全面的用户理解

-

元学习能力

- 系统能够自我进化,适应新的用户行为模式

- 减少人工调参依赖

某知名AI科学家预测:“5年内,最好的推荐系统将不再是‘推荐’系统,而是用户的认知伙伴——它比用户自己更了解他们的深层需求。”

💎 总结:技术融合的艺术

关联规则与GNN的结合,本质上是符号主义与连接主义的完美融合:

- 关联规则(符号主义):提供可解释性、业务逻辑

- GNN(连接主义):提供表示学习、推理能力

这种融合不是简单的技术堆砌,而是需要深度的业务理解和巧妙的技术设计。成功的核心在于:让每个技术做自己最擅长的事,然后通过巧妙的架构设计实现协同效应。

正如一位资深算法架构师所说:“最好的技术方案不是最复杂的,而是最能解决业务问题的。关联规则+GNN的魅力就在于,它既保持了业务的可解释性,又突破了传统方法的天花板。”

当你掌握了这种技术融合的艺术,你的推荐系统将真正实现从“猜你喜欢”到“未卜先知”的跨越,为用户创造前所未有的个性化体验,为业务带来指数级的价值增长。

还记得那个经典的“啤酒与尿布”故事吗?超市发现这两个看似毫不相关的商品经常被一起购买,于是调整货架布局,销售额显著提升。这个案例之所以经典,不仅因为它展示了关联规则的力量,更因为它揭示了商业世界中隐藏的“关系价值”。

但今天,我们要讲一个更宏大的故事——当关联规则遇见知识图谱,商业洞察的维度将从“点对点”的简单关联,升级到“万物互联”的复杂网络。

🔍 知识图谱:从“关联”到“关系”的认知跃迁

传统关联规则告诉我们“A和B经常一起出现”,但知识图谱回答的是“A和B为什么相关”。这中间的差距,就是商业价值的倍增空间。

知识图谱的本质是语义网络——它不仅记录实体间的共现频率,更刻画实体间的语义关系。比如“啤酒-尿布”案例,知识图谱会进一步记录:

- 购买者特征:年轻爸爸(25-35岁男性)

- 购买场景:周五晚上、周末采购

- 行为动机: convenience(方便)、时间节约

- 关联强度:不是简单的“经常一起买”,而是“在特定场景下强关联”

这种深度关系刻画,让商业决策从“猜测”走向“理解”。

🏗️ 知识图谱的技术架构:三层次价值释放

底层:数据融合与知识抽取

传统企业数据往往散落在CRM、ERP、SCM等不同系统中,形成数据孤岛。知识图谱通过统一的语义模型,将这些异构数据整合成连贯的知识网络。

实体识别与链接是核心挑战。以零售业为例,同一个供应商在不同系统中的名称可能不同(如“阿里巴巴集团”vs“阿里”),知识图谱通过实体解析技术,自动识别并链接这些别名,构建统一的供应商画像。

中层:关系推理与路径发现

这是知识图谱的价值核心层。基于图算法,系统能够发现间接但重要的商业关系。

经典案例:供应链风险预警 某制造企业通过知识图谱分析供应商关系,发现:

- 供应商A是核心零部件唯一来源

- 供应商A的原材料60%来自供应商B

- 供应商B所在地区近期有自然灾害风险

- 推理结论:虽然供应商A本身稳定,但通过B的传导,企业面临潜在的供应链中断风险

这种多层关系推理,让企业能够提前90天预警传统方法无法发现的风险。

上层:智能应用与决策支持

知识图谱的真正价值在于赋能具体业务场景:

智能推荐系统2.0 传统协同过滤只能做到“买A的人也买B”,而知识图谱驱动的推荐系统能够:

- 理解用户意图(基于历史行为构建用户兴趣图谱)

- 挖掘深度关联(不仅商品共现,更考虑功能互补、场景适配)

- 实现跨品类推荐(基于知识图谱的语义关联)

实际效果:某电商平台引入知识图谱后,跨品类推荐点击率提升47%,GMV贡献增长32%。

📊 知识图谱的商业价值量化

知识图谱的价值不是抽象的“更好理解”,而是可量化的商业回报:

🌐 从“企业知识图谱”到“产业知识图谱”的演进

单个企业的知识图谱价值已经显著,但当多个企业的知识图谱互联时,将产生网络效应般的价值倍增。

产业知识图谱的实践案例: 某汽车产业集群搭建了覆盖整车厂、零部件供应商、物流服务商的产业知识图谱:

- 共享产能信息,实现订单的智能匹配与产能协同

- 基于供应商关系网络,共同应对原材料价格波动

- 通过技术知识图谱,加速创新技术的扩散应用

结果:集群整体运营效率提升22%,创新周期缩短40%。

🚀 知识图谱实施的实战指南

阶段一:MVP验证(1-3个月)

目标:证明概念价值,获得内部支持 关键行动:

- 选择高价值、数据准备度好的场景(如供应商风险预警)

- 构建最小可行知识图谱(50-100个核心实体,500-1000个关系)

- 产出具体业务洞察,量化价值

阶段二:能力建设(3-12个月)

目标:建立企业级知识图谱基础设施 关键行动:

- 制定知识图谱标准与规范

- 建设知识抽取、融合、推理的自动化流水线

- 培养内部知识图谱专家团队

阶段三:生态扩展(12个月+)

目标:实现跨组织知识共享与协同 关键行动:

- 建立数据交换与隐私保护机制

- 设计价值分配与激励机制

- 推动行业标准制定与采纳

💡 知识图谱落地的常见陷阱与应对

陷阱一:过度工程化

- 症状:追求完美的本体设计,迟迟无法产出业务价值

- 解药:采用迭代式开发,优先保证80%覆盖度的“够用就好”设计

陷阱二:数据质量魔咒

- 症状:等待“完美数据”,项目停滞不前

- 解药:接受数据不完美现实,建立数据质量改进与知识图谱建设并行的双轨机制

陷阱三:技术驱动而非业务驱动

- 症状:团队沉迷于技术先进性,忽视业务痛点

- 解药:每个知识图谱项目必须明确绑定关键业务指标(KPI)

🔮 知识图谱的未来:认知智能的商业化

知识图谱正在从“静态知识库”向“动态认知系统”演进。结合图神经网络(GNN)和推理技术,未来的知识图谱将具备:

预测性推理能力 不仅回答“现在是什么”,更能预测“未来会怎样”。比如基于产业关系网络,预测技术扩散路径和市场格局演变。

自主决策能力

在规则明确的场景下,知识图谱驱动的智能体能够自动做出优化决策。如基于实时供应链知识图谱,自动调整采购策略应对市场变化。

跨模态理解能力 融合文本、图像、语音等多模态信息,构建更加丰富的知识表示。这将极大扩展知识图谱的应用边界。

从“啤酒尿布”的简单关联,到“万物互联”的复杂认知,知识图谱正在重新定义商业智能的边界。这不仅是技术的升级,更是商业思维范式的转变——从关注单个交易的价值,到挖掘关系网络的价值。

下一个十年,最大的商业机会可能不再来自于拥有更多数据,而是来自于更好地理解数据之间的关系。你的企业,准备好绘制自己的商业宇宙地图了吗?

70%的AI项目失败不是因为算法不够好,而是因为路线图不够清晰。过去三年,我们看到太多企业在这个坑里栽跟头:零售巨头千万级推荐系统准确率不如人工规则、制造企业因数据质量差导致30%误判、金融机构盲目上大模型带来合规风险。

成功的AI项目都有一个共同特征:从具体业务痛点出发,而非技术酷炫。用简单算法先验证价值,再逐步升级。本章将为你提供一套经过验证的落地路线图,帮你避开那些让同行付出惨痛代价的陷阱。

🎯 第一阶段:战略定位与价值锚定(0-1个月)

"先想清楚做什么,再考虑怎么做"——这是所有成功AI项目的黄金法则。

战略对齐:从业务痛点倒推技术选型

- 价值定位三问:AI究竟要帮助企业实现什么?是降低成本、提升效率还是重构商业模式?

- 业务目标对齐:每个AI项目必须直接支撑明确的业务目标,如提升客户满意度10%、缩短产品上市时间30%或降低运营成本15%

- 阶段化推进路径:遵循"先优化流程,实现业务在线,再治理数据,实现数据驱动,最后部署专业大模型和智能体,实现智能运营"的理性发展路径

避免"为AI而AI"的陷阱

- 神州数码的实践表明:AI for Process的本质远超工具层面,它是一种以AI为核心驱动力的新型流程管理范式变革

- 用友集团副总裁郭金铜强调:企业应用AI应遵循三步走——先优化流程,实现业务在线,再治理数据,实现数据驱动,最后部署专业大模型和智能体

双驱动模型:平衡长期战略与短期价值

- 自顶向下:从战略出发,将业务流程拆解为多层级体系,系统性优化流程

- 自底向上:从具体操作出发,在已有流程中寻找AI切入点,逐步沉淀价值

📊 第二阶段:需求分析与机会识别(1-2个月)

业务痛点诊断:找到真正的"痛点"而非"痒点"

阿里云智能集团CIO负责人蒋林泉提出的RIDE方法论中,第一个环节就是"Reorganize(重组组织与生产关系)"。他认为"如果不解决新生产力下的组织和生产关系问题,就会不断遇到暗礁,甚至没法往前走"。

高效需求分析的四步法:

- 业务流程映射:可视化端到端业务流程,识别瓶颈、冗余和非价值环节

- 痛点优先级评估:基于影响程度、发生频率和解决难度三个维度排序

- 利益相关者分析:全面识别受影响的所有群体,理解核心诉求

- AI机会评估:将痛点转化为AI可行解决方案

AI机会评估标准:

- 适合AI化的业务场景特征:重复性高、规则明确、数据可获得性强、容错率适中

- 技术可行性评估:数据可用性、质量与标注成本;现有技术栈兼容性

- 业务价值评估:量化预期效率提升、错误率降低和成本节约

表:AI机会评估优先级矩阵

可行性验证:小规模概念验证(POC)

- 在投入大量资源前,通过POC验证核心假设的技术可行性和业务价值

- 根据ROI评估原则,如果AI的一次使用成本高于当前人力成本,那么从经济上来说没必要改造

🏗️ 第三阶段:技术实施与架构设计(2-4个月)

企业级AI架构设计:确保可扩展、可持续演进

2024-2025年的技术架构趋势明显朝向"AI原生"理念发展。神州数码提出的AI原生企业数智化参考架构由两大核心平台构成:Agent中台与智能流程工作台。

现代企业AI架构关键层次:

- 基础设施层:GPU集群、云原生资源和网络架构

- 数据与模型层:数据治理、特征工程、模型仓库和MLOps平台

- AI能力层:Agent中台、工具库和API管理

- 应用层:面向具体业务场景的智能应用和流程工作台

技术选型与模型策略:平衡多重要素

- 模型性能与成本:平衡精度与推理成本,避免"过度工程化"

- 数据隐私与安全:对于敏感数据场景,私有化部署成为必要条件

- 集成与兼容性:评估与现有系统的集成难度

- 供应商生态与支持:考虑长期稳定性、技术支持和社区活跃度

表:企业AI技术选型考虑因素

实施方法论:敏捷交付确保成功落地

- 迭代开发:采用短周期迭代,优先构建最小可行产品(MVP)

- 持续集成与部署:建立MLOps流程,实现自动化训练、测试和部署

- 测试与验证:涵盖功能测试、性能测试、安全测试和用户体验测试

数据准备与治理:AI成功的基础条件

- 数据质量框架:建立准确性、完整性、一致性和时效性等标准

- 标注流程优化:结合主动学习和半自动标注技术降低成本

- 特征工程标准化:建立可复用的特征库,促进特征共享

- 隐私与合规:实施数据脱敏和访问控制措施

👥 第四阶段:组织变革与人才保障(持续进行)

组织架构重塑:AI成功的隐形支柱

神州数码发布的蓝皮书强调,构建敏捷协同的组织模式是AI for Process的核心要素之一。这包括组建跨职能团队并赋予充分决策自主权。

适应AI时代的组织设计原则:

- 跨职能协作机制:打破部门壁垒,组建业务专家、数据科学家、工程师的跨职能团队

- 决策权下放:赋予前线团队适当的决策权,快速响应问题

- 人机协同设计:明确人类与AI的职责边界,设计高效协作流程

人才战略与能力建设:AI就绪企业的核心特征

- 内部技能提升:通过定制化培训项目提升现有员工的AI素养

- 专项人才引进:针对关键角色如提示工程师、AI产品经理适时引入外部专家

- 知识管理体系:建立机制促进AI知识的捕获、传播和复用

文化变革与激励机制:维系转型动力的软性要素

- 实验平台与资源:提供沙盒环境和小额实验资金,允许测试AI想法

- 成功案例分享:定期组织内部分享会,传播AI成功故事

- 指标与奖励体系:将AI采纳度和价值创造纳入绩效考核

表:AI时代组织变革的关键维度

📈 第五阶段:ROI评估与价值衡量(持续监控)

ROI评估框架:衡量AI投资回报的核心工具

领先企业普遍采用"2个时间轴×6个价值维度"的AI-ROI矩阵,分为0-6个月的早期趋势性ROI以及长期实现性ROI。

全面的AI项目ROI评估要素:

- 总体拥有成本:除了显性成本,还需考虑数据清洗、标注、算力等隐性支出(平均占45%)

- 多维价值指标:建立涵盖财务、流程、决策和体验的多维指标矩阵

- 动态评估机制:ROI评估嵌入项目全生命周期,每月滚动校准

成本效益分析:科学量化投入与产出

- 成本侧:采用总体拥有成本视角,识别所有相关成本项

- 效益侧:创造性量化"软性"价值,如运营效率、客户体验等

表:AI项目ROI评估的多维指标

价值实现与持续优化:ROI管理的最终目的

- AI项目的价值实现往往遵循抛物线式的"复利"效应,效果前慢后快

- 建立持续优化机制:持续监测体系、归因分析技术、定期复盘机制

平衡短期与长期价值:AI投资决策的关键考量

- 避免过度关注短期财务回报而牺牲长期战略价值

- 神州数码提出的"AI渗透率"概念帮助企业衡量AI应用进程

🚨 十大避坑指南:前人踩过的坑,你无需再踩

-

技术驱动陷阱:为技术酷炫而忽略业务价值

- 解决方案:始终坚持"业务价值驱动"原则

-

数据质量魔咒:在脏数据上构建AI大厦

- 解决方案:先治理数据,再部署模型

-

试点困境:个别场景试点成功但难以规模化

- 解决方案:建立标准化、可复用的AI资产

-

组织抵抗:员工担心被替代而产生抵触

- 解决方案:早期沟通、参与式设计、再技能计划

-

过度工程化:追求完美解决方案而延误时机

- 解决方案:采用敏捷迭代,小步快跑

-

算力成本失控:模型推理成本超出业务价值

- 解决方案:建立成本监控和优化机制

-

合规风险:忽视数据隐私和行业监管要求

- 解决方案:在设计之初就考虑合规要求

-

供应商锁定:过度依赖单一技术供应商

- 解决方案:坚持开放、可扩展的技术选型原则

-

期望管理失败:过度承诺导致信任危机

- 解决方案:设定合理期望,分阶段展示成果

-

持续优化缺失:项目上线后缺乏维护和迭代

- 解决方案:建立MLOps体系和持续优化机制

🎯 成功的关键:路线图比算法更重要

AI项目的成功,20%靠算法,80%靠实施路线图。技术只是工具,真正的价值在于如何将工具与业务完美结合。

华为提出的"三层五阶八步"落地方法论强调"场景重构、流程再造、组织优化、数据治理及IT基础设施升级"的多维协同。阿里云蒋林泉的RIDE方法论包括:Reorganize(重组组织与生产关系)、Identify(识别业务痛点与AI机会)、Define(定义指标与运营体系)、Execute(推进数据建设与工程落地)。

这些方法论共同指向一个核心结论:成功的AI实施是战略驱动的业务转型,而非单纯的技术项目。

记住:最早掌握正确实施方法论的企业将获得显著竞争优势。在这场AI革命中,路线图清晰的企业将笑到最后。

"这玩意儿到底能帮我多赚多少钱?"

这是每个老板看到AI项目提案时的第一反应。2024-2025年的实践表明,AI项目的ROI评估需要分层量化:

- 短期速赢(3-6个月):流程自动化带来的直接人力成本节约。例如,某电商客服中心引入AI助手后,简单咨询自动化率提升至65%,每月节省人工成本28万元。

- 中期价值(6-12个月):效率提升带来的业务增长杠杆。如制造企业通过AI质检将漏检率从3%降至0.1%,每年避免质量赔款近千万元。

- 长期战略(12个月以上):商业模式创新的估值重构。典型案例如某传统零售企业通过AI重构"人货场",估值从PE 15倍提升至科技公司水平的35倍。

关键指标:不要只汇报"准确率95%"这种技术指标,而要换算成"单次决策成本从38元降至2元,错误率降低带来的风险成本节约年均470万"这样的老板语言。

"数据从哪儿来?质量行不行?"

数据是AI的"燃料",但老板最怕的是"燃油费比车还贵"。2025年的解决方案是分级治理:

- 核心数据(客户交易、生产记录):必须100%清洗达标,投入重兵治理

- 辅助数据(行为日志、外部数据):采用"够用就好"原则,成本控制在项目总预算15%以内

- 创新数据(新型传感器数据):小规模试点验证价值后再大规模投入

某银行风控项目的实战经验:先聚焦最关键的20%数据字段(账户流水、交易方信息),确保质量达到99.9%准确率,剩余数据采用AI自动补全,将数据准备成本压缩了60%。

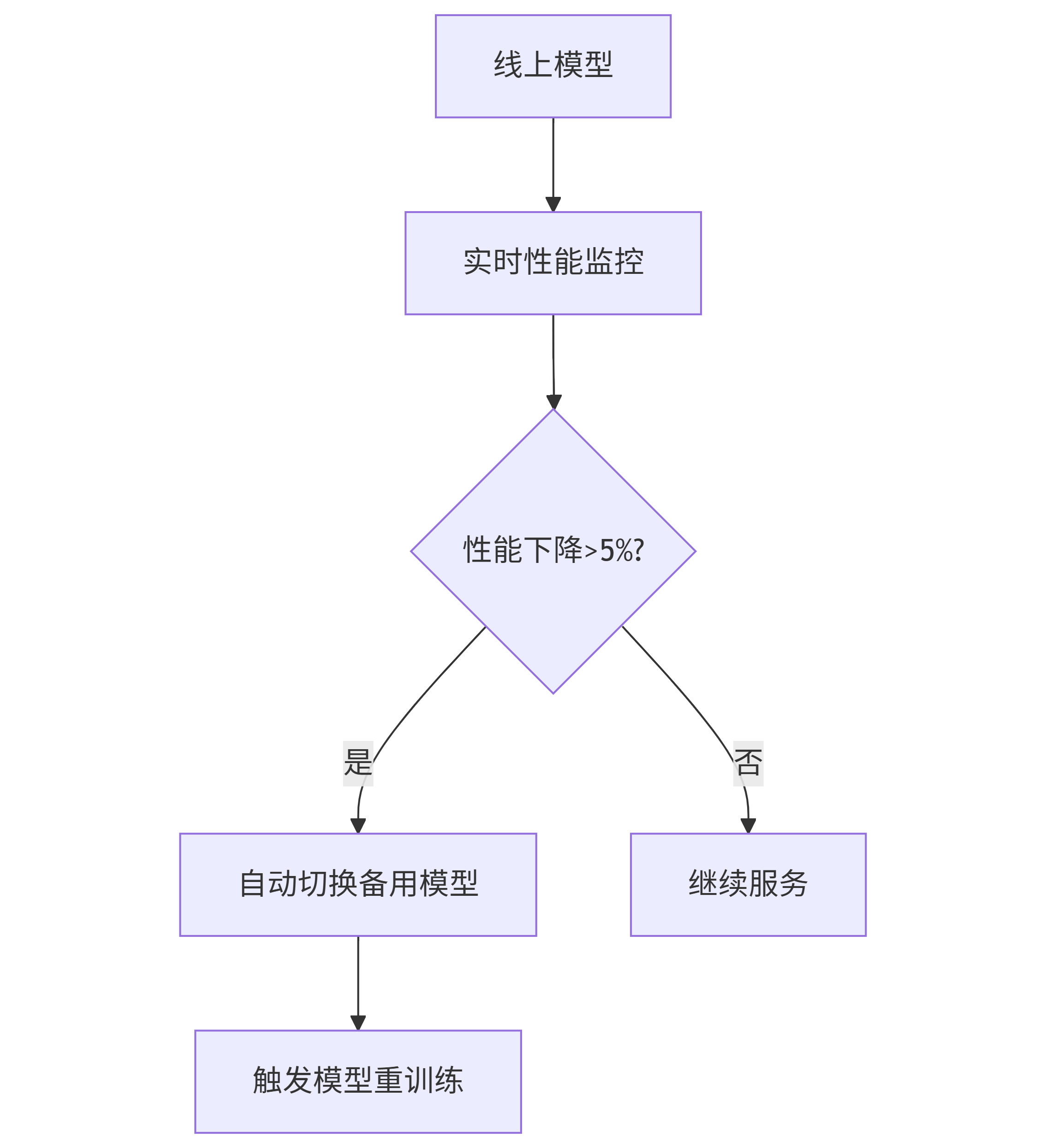

"会不会用着用着就失灵了?"

模型衰减是老板最大的隐忧。2025年的最佳实践是建立双轨制监控体系:

某金融机构的实战数据:通过建立预测偏差预警机制,在信用卡欺诈检测模型性能下降初期(准确率从98.3%降至96.7%)就自动触发更新,避免了可能的上亿元损失。

"投入这么多,竞争对手抄起来容易吗?"

构建可防御的AI壁垒需要三层设计:

- 数据壁垒:你的独家数据源(如10年积累的500TB工业设备运行数据)

- 算法壁垒:针对业务特点定制的集成模型(如结合行业知识的混合推荐算法)

- 工程壁垒:高度优化的实时推理系统(毫秒级响应的风控引擎)

某电商平台的案例:其推荐系统融合了实时用户行为、供应链数据和季节性趋势,即使竞争对手拿到算法代码,没有对应的数据流水线也难以复制效果。

"团队能接得住吗?会不会被供应商绑架?"

2025年的人才策略是内外结合:

- 核心能力自建:培养3-5人的内部AI核心团队,掌握模型调优和业务理解

- 非核心外包:数据标注、基础模型训练等采用弹性外包

- 供应商锁定预防:合同明确要求代码开源和知识转移

某制造企业的成功经验:通过"1个内部专家+2个供应商+N个业务接口人"的模式,在9个月内实现了从完全依赖外包到70%自主运维的过渡。

"合规风险有多大?踩雷了谁负责?"

AI治理的三道防线模型:

- 技术防线:模型可解释性工具,每个决策可追溯

- 流程防线:关键决策保留人工审核环节(如信贷审批超过50万必须人工复核)

- 制度防线:明确的AI使用规范和问责机制

某医疗AI企业的做法:在辅助诊断系统中设置置信度阈值,当模型置信度低于90%时自动转交人类专家,既保障了安全又明确了责任边界。

"现在投是不是太早?等技术成熟再跟会不会更划算?"

2024-2025年的市场现实是:早期投入者已形成马太效应。数据分析显示:

- 先行者(2019-2021年投入):平均需要18个月实现盈亏平衡,但建立了难以逾越的数据和算法优势

- 跟进者(2022-2023年投入):盈亏平衡期缩短至12个月,但获客成本比先行者高30%

- 观望者(2024年仍未投入):面临"不投入等死,投入找死"的两难困境

"怎么证明这不仅仅是又一个科技噱头?"

用最小可行产品(MVP)验证法打破质疑:

- 选择高价值场景:如"用AI优化库存周转"而非"全面AI转型"

- 设定明确基准:当前库存周转率45天,目标降至35天

- 快速验证:在3个仓库试点,8周内看到周转率改善至38天

- 规模化推广:基于数据说服决策层扩大投入

某零售企业用此方法,将AI项目获批时间从平均6个月缩短至45天。

"投入产出周期多长?现金流能不能撑住?"

AI项目的现金流规划技巧:

- 分阶段投入:将1000万预算拆分为200万(验证期)+300万(推广期)+500万(深化期)

- 弹性预算:设置20%的预备金应对不确定性

- 早期变现:即使在验证期也要设计变现路径,如将内部开发的AI工具对外提供服务产生收入

某物流企业的实战经验:通过将内部路径优化算法封装为SaaS服务,在项目第6个月就实现了正向现金流。

"万一失败了,最坏情况是什么?退出机制有哪些?"

理性的AI投资者都会准备B计划:

- 技术失败:有备选技术方案(如规则引擎fallback)

- 业务失败:积累的数据资产可重新利用(如用户画像数据可用于其他业务)

- 完全失败:明确止损点(如连续6个月ROI低于15%即终止项目)

某金融科技公司的"软着陆"设计:即使AI信贷模型失败,过程中构建的数据中台和实时计算能力也能用于其他业务线,确保投入不完全打水漂。

终极拷问:"凭什么相信你能做成?"

这是对团队能力的灵魂拷问。2025年的回答模板需要包含:

- 过往战绩:"我们团队在上一家公司用类似方法将客服成本降低了40%"

- 方法论自信:"采用的分阶段验证法已在实际项目中验证过5次"

- 风险预案:"即使最坏情况发生,我们也有确保核心业务不受影响的方案"

- 资源保障:"已获得技术委员会和业务部门的双重支持"

决策沙盘实战:老板最关心的数字清单

记住,老板们不关心技术有多炫酷,只关心能不能赚钱、会不会赔钱、能不能持续。用他们听得懂的语言,算他们看得懂的账,这才是AI项目获得支持的关键。

这不是学习计划,而是商业对话能力速成方案

如果你刚读完前十三章,可能会觉得AI世界太复杂——技术栈深不见底,行业案例眼花缭乱,老板的灵魂拷问直击要害。但好消息是:30天内掌握与CTO对话的商业语言,比学会所有技术容易10倍。

我见过太多技术牛人因为不会说“老板能听懂的话”而错失机会,也见过业务高手因不懂技术逻辑而被工程师“忽悠”。这一章就是你的商业语言速成手册。

🎯 第1周:夯实商业技术地基(Day 1-7)

目标:从“技术小白”到“能看懂技术方案商业价值”

Day 1-2:建立AI价值认知框架

- 核心任务:彻底理解“AI价值=业务痛点重要性×技术可行性”这个公式

- 具体行动:选择你所在行业的一个具体场景(如电商的推荐系统、制造的设备预测性维护),用这个框架分析:

- 业务痛点有多痛?(量化:影响收入/成本的具体数字)

- 技术可行性如何?(数据是否足够?现有技术能否解决?)

- 输出物:一份500字的“AI机会评估报告”,用老板能看懂的语言描述

Day 3-4:掌握技术选型商业逻辑

- 核心任务:学会用“技术选型矩阵”做决策,不再被技术名词吓倒

- 具体行动:对比Apriori/FP-Growth、Wide&Deep、GNN三种算法在你们行业的适用性:

- 数据规模要求(小数据/大数据?)

- 解释性要求(需要向老板解释清楚吗?)

- ROI周期(快赢项目还是长期投入?)

- 输出物:一张技术选型对比表,标注每种技术的商业优缺点

Day 5-7:数据质量商业评估

- 核心任务:用“数据质量六维框架”评估你们公司数据的商业价值

- 具体行动:找一份你们部门的真实数据(销售数据、用户行为数据等),从六个维度打分:

- 完整性(缺多少数据?)

- 准确性(错误率多高?)

- 一致性(不同系统数据是否冲突?)

- 时效性(数据更新频率?)

- 唯一性(重复数据多少?)

- 合规性(使用是否合法?)

- 输出物:数据质量评估报告,指出修复数据能带来的具体商业价值

第一周成果:你不再说“我们需要机器学习”,而是说“通过关联规则分析,我们能将交叉销售转化率提升15%,预计年增收入300万”。

🚀 第2周:行业案例深度拆解(Day 8-14)

目标:掌握用行业案例说服决策者的能力

Day 8-10:拆解成功案例的商业逻辑

- 核心任务:深度分析2个与你行业相关的成功案例(如电商的关联规则、制造的预测性维护)

- 具体行动:

- 找到案例的具体数字(如GMV提升12.7%、单条产线年省480万)

- 分析其成功关键:是技术先进还是业务场景选得好?

- 对比你们公司类似场景,找出可复用的点

- 输出物:案例拆解PPT,用“背景-问题-方案-结果”框架呈现

Day 11-12:失败案例避坑分析

- 核心任务:了解AI项目失败的常见原因,避免踩坑

- 具体行动:研究2个失败案例,分析失败根源:

- 是技术不成熟还是业务需求不清晰?

- 是数据质量差还是组织不接受?

- 如果让你来做,会如何避免这些坑?

- 输出物:避坑清单,列出你们公司可能遇到的5个风险点及应对策略

Day 13-14:制作你的商业案例

- 核心任务:基于前两周学习,为你们公司设计一个AI试点项目

- 具体行动:

- 选择一个小而具体的业务场景

- 估算预期商业价值(用具体数字)

- 规划实施路径和资源需求

- 设计ROI评估方案

- 输出物:1页纸项目建议书,包含问题、方案、预期收益、资源需求

第二周成果:你能在会议上说:“参考XX公司的案例,我们用类似方法能在3个月内实现成本降低10%,这是具体实施方案…”

💡 第3周:技术沟通能力提升(Day 15-21)

目标:学会与技术人员高效沟通,推动项目落地

Day 15-16:掌握技术方案评估框架

- 核心任务:学会用“技术-业务翻译框架”评估技术方案

- 具体行动:找一份真实的技术方案文档,练习:

- 将技术术语翻译成业务价值(如“准确率95%”→“减少人工审核成本200万/年”)

- 识别方案中的风险点(数据风险、技术风险、业务风险)

- 提出改进建议

- 输出物:技术方案评估报告,用红黄绿灯标注各环节风险

Day 17-18:学习项目管理商业语言

- 核心任务:掌握AI项目管理的核心指标和汇报方式

- 具体行动:设计一个AI项目的关键指标看板:

- 技术指标(模型准确率、响应时间等)

- 业务指标(成本节约、收入增长等)

- 项目指标(进度、预算、资源等)

- 输出物:项目指标看板设计,包含数据来源和更新机制

Day 19-21:模拟CTO对话演练

- 核心任务:通过角色扮演提升高层沟通能力

- 具体行动:找同事模拟以下场景:

- 向CTO汇报项目进展(5分钟简报)

- 争取项目资源(为什么这个项目值得投资?)

- 处理项目危机(当项目出现问题时如何沟通?)

- 输出物:沟通话术模板和常见问题应答指南

第三周成果:你能与技术团队用同一语言沟通,能向高层清晰汇报项目价值,能有效推动项目落地。

🏆 第4周:实战演练与能力认证(Day 22-30)

目标:通过实战检验学习成果,建立个人品牌

Day 22-24:完整项目实战

- 核心任务:完成一个端到端的迷你AI项目

- 具体行动:选择一个小场景(如销售数据关联分析、客户分群等):

- 业务需求分析(要解决什么业务问题?)

- 数据准备与清洗(获取并处理真实数据)

- 简单模型应用(使用现成工具实现)

- 结果分析与商业价值估算

- 输出物:完整项目报告,包含从需求到价值的全流程

Day 25-27:建立个人知识体系

- 核心任务:整理学习成果,建立个人AI知识库

- 具体行动:

- 制作个人AI知识地图(技术概念、案例、方法论)

- 编写常见问题应答手册(针对不同受众的版本)

- 建立持续学习机制(如何跟踪AI最新发展?)

- 输出物:个人AI知识库,包含学习笔记、案例库、工具集

Day 28-29:模拟CTO答辩

- 核心任务:通过高压模拟检验真实能力

- 具体行动:邀请有经验的同事或导师,模拟CTO级别的质询:

- 项目商业价值质疑(ROI是否真实?)

- 技术方案挑战(为什么选这个技术?)

- 风险评估(可能失败的原因?)

- 资源争夺(为什么这个项目优先级更高?)

- 输出物:答辩反馈和改进计划

Day 30:成果验收与规划

- 核心任务:验收30天学习成果,制定下一步计划

- 具体行动:

- 回顾30天学习成果(量化进步)

- 识别能力差距和提升方向

- 制定3个月AI能力提升计划

- 寻找实践机会(公司项目、行业交流等)

- 输出物:个人AI能力发展计划书

第四周成果:你不再需要“准备”与CTO对话,因为AI商业思维已经成为你的本能反应。

📊 30天蜕变的关键指标

学习前vs学习后的能力对比:

🛠️ 你的30天工具箱

每日学习模板:

- 早晨15分钟:阅读一个AI商业案例

- 中午30分钟:实践一个具体技能

- 晚上15分钟:总结记录学习心得

进度跟踪工具:

- 学习打卡表(确保每日坚持)

- 能力进步雷达图(每周更新)

- 实践项目里程碑(清晰可见的成果)

资源支持体系:

- 行业案例库(随时参考)

- 工具模板集(快速上手)

- 问答社区(及时解惑)

最重要的一句话:这30天不是学技术,而是学商业思维。 你的目标不是成为AI专家,而是成为“懂AI的商业人才”——这是当前市场上最稀缺、价值最高的人才类型。

当30天后你能与CTO平等对话时,你会发现:AI不是神秘技术,而是解决问题的工具;你不是技术追随者,而是价值创造者。

恭喜你!如果你已经读到这里,说明你已经掌握了关联规则挖掘的技术精髓和行业应用秘籍。但真正的价值不在于技术本身,而在于如何将技术转化为商业价值——这一章,我将带你从技术专家升级为商业价值的创造者。

💼 从技术到商业的价值跃迁思维

技术专家的思维陷阱:我们往往沉迷于算法的精妙、模型的准确率、代码的优雅。但在商业世界里,老板和客户关心的只有一件事:这个技术能帮我赚多少钱(或者省多少钱)?

价值销售的核心公式:

技术价值 = (收益提升 + 成本节约) × 可量化证据 × 决策者信任度

让我用两个真实案例告诉你,同样的技术如何卖出完全不同的价格:

案例A(技术思维): "我们用了最新的FP-Growth算法,支持度0.01,置信度0.8,发现了156条有价值的关联规则…"

案例B(商业思维): "通过分析您过去一年的交易数据,我们发现了一个机会:将早餐套餐与咖啡捆绑销售,可以让早餐时段销售额提升18%,每年额外创造480万营收。这个方案实施成本50万,4个月回本。"

你觉得客户会为哪个方案买单?

🎯 识别高价值销售场景的"黄金三问"

在向企业销售关联规则项目前,先问自己这三个问题:

-

这个问题是否影响企业的核心KPI?

- 如果是GMV、利润率、客户留存率等核心指标 → 高价值

- 如果是边缘指标 → 低价值

-

解决方案是否具备可量化的ROI?

- 能精确计算投资回报周期 → 高价值

- 只有模糊的"效率提升" → 低价值

-

决策链条是否清晰?

- 有明确的预算负责人和决策流程 → 高价值

- 需要跨多个部门协调 → 低价值

实战技巧:在与客户初次接触时,用这"黄金三问"快速筛选项目优先级,把精力集中在真正有价值的机会上。

💰 构建千万级项目的定价策略

错误的定价方式:按人天计费、按代码行数计费、按算法复杂度计费。

正确的定价策略:价值共享定价

关键洞察:你的定价应该与为客户创造的价值成正比,而不是与你的工作量成正比。千万级项目的客户不缺钱,他们缺的是能带来真实价值的解决方案。

📊 制作让CEO动心的商业案例

技术专家最大的败笔就是把技术细节摆在第一位。正确的顺序应该是:

商业案例金字塔结构:

- 顶层(5分钟讲清楚):我们要帮你多赚多少钱/少花多少钱

- 中层(深入讨论时):我们用什么方法实现这个目标

- 底层(技术评审时):具体的技术方案和实现细节

实战模板:一页纸商业案例

【项目名称】:智能交叉销售提升计划

【业务问题】:当前客户单次购买商品数平均1.2个,远低于行业标杆2.5个

【解决方案】:通过关联规则挖掘发现高价值商品组合,实现精准推荐

【预期收益】:客单价提升60%,年新增营收3200万元

【投资需求】:项目实施费用180万元,技术平台费用120万元

【回报周期】:6个月回本,第1年净收益2800万元

【风险控制】:小范围A/B测试验证效果,分阶段推广

🤝 搞定关键决策者的沟通策略

不同的决策者关心不同的价值点,要学会"见人说人话":

面对CEO/董事长:

- 关注点:战略价值、竞争优势、资本市场故事

- 话术:"这个项目能让我们的估值倍数从15倍提升到20倍"

面对CFO/财务总监:

- 关注点:ROI、现金流影响、风险控制

- 话术:"6个月回本,第1年产生2800万净现金流,最坏情况止损点明确"

面对业务总监:

- 关注点:业绩提升、团队激励、执行可行性

- 话术:"你的团队KPI能轻松超额完成,而且不需要增加人手"

面对CTO/技术总监:

- 关注点:技术先进性、系统稳定性、团队成长

- 话术:"这是业界最前沿的GNN+关联规则混合架构,能大幅提升你们团队的技术影响力"

🚀 项目实施的五个关键阶段

阶段一:价值锚定(1-2周)

- 目标:与客户共同明确最关键的业务指标

- 产出:双方签字确认的价值评估框架

- 技巧:让客户参与价值指标的制定,增强认同感

阶段二:数据验证(2-4周)

- 目标:验证数据的可用性和质量

- 产出:数据质量评估报告+初步价值验证

- 技巧:快速做出一个最小可行性demo,让客户看到希望

阶段三:方案设计(3-4周)

- 目标:设计完整的解决方案

- 产出:详细的技术方案+商业实施方案

- 技巧:设计多个备选方案,让客户有选择权

阶段四:实施交付(8-12周)

- 目标:完成系统实施和业务上线

- 产出:可运行的系统+使用培训

- 技巧:每周向决策者汇报进展,保持高层关注度

阶段五:价值验证(持续)

- 目标:持续验证和优化价值创造

- 产出:定期的价值实现报告

- 技巧:主动帮客户发现新的价值机会,为续约做准备

💡 避免千万级项目的常见陷阱

陷阱一:过度承诺

- 症状:为了拿下项目,承诺无法实现的效果

- 解药:基于数据做保守估计,预留安全边际

陷阱二:技术自嗨

- 症状:沉迷于技术优化,忽视商业价值

- 解药:设立明确的价值验证节点,及时调整方向

陷阱三:关系依赖

- 症状:过度依赖某个关键联系人

- 解药:在客户内部建立多层次的支持网络

陷阱四:交付即结束

- 症状:项目交付后就不再关注客户

- 解药:建立长期价值伙伴关系,挖掘续约机会

🌟 从项目到产品的升级路径

真正的千万级玩家不是一个个地做项目,而是把项目经验产品化:

第一步:项目经验沉淀

- 每个项目结束后,总结可复用的模式和方法论

- 建立自己的"行业解决方案库"

第二步:产品化思维

- 将成功的项目经验打包成标准化产品

- 设计可配置、可扩展的解决方案框架

第三步:生态构建

- 与行业伙伴合作,共同推广解决方案

- 建立自己的实施合作伙伴网络

第四步:平台化运营

- 将解决方案升级为SaaS平台

- 从一次性项目收入升级为持续性服务收入

💎 成为千万级顾问的终极心法

心法一:你不是在卖技术,而是在卖成功

- 客户买的不是算法,而是业绩提升的保证

心法二:价值要可见,更要可量化

- 用具体的数字说话,避免模糊的价值描述

心法三:先成为客户的成功伙伴,再成为供应商

- 站在客户的角度思考问题,共同创造价值

心法四:持续学习,但始终聚焦商业价值

- 技术会过时,但创造价值的能力永远不会

记住,在这个AI技术日益普及的时代,单纯的技术能力正在快速商品化。真正的稀缺资源是将技术转化为商业价值的能力。掌握了这个能力,你就不再是一个可替代的技术专家,而是一个不可或缺的商业价值创造者。

现在,你已经具备了从技术专家到商业价值创造者的全部思维框架和实战工具。下一步就是行动——找到你的第一个高价值客户,开始实践这些方法论。千万级的项目就在前方等着你!

关联思维正在从"发现规律"的工具,升级为"重构商业"的引擎。前十五章我们已经见证了关联规则在电商、金融、医疗、制造等领域的单点突破,但真正的革命才刚刚开始——多模态AI Agent将把这些孤立的智能点连接成自主进化的商业神经网络。

🤖 多模态AI Agent:从"能看会听"到"能想会做"

2024-2025年,AI正在经历从模型能力建设向现实世界深度渗透的关键转折。多模态大模型已超越了简单的感知与生成,向更深度的环境理解和自主推理演进。

技术突破的核心在于视觉-语言-推理的深度融合:

- 快手开源的Keye-VL-671B模型不仅能识别图像中的票据细节,还能进行逻辑推理,判断出其中一张实为食品兑换券

- 昆仑元AI发布的BaiZe-Omni模型展示了文本、音频、图像、视频同步生成与理解的能力

- 行业重心从追求参数规模转向提升推理效率和降低算力成本,预计到2027年,推理算力在AI算力中的占比将大幅提升

AI Agent获得了初步的"手脚",能够理解目标、规划任务、调用工具,完成从指令到结果的闭环。行业已将AI Agent的能力划分为L1-L4等级:

- L4级智能体(如纳米AI的蜂群系统)能实现多智能体协作,像搭积木一样灵活组队分工

- 百度智能云的AI数字员工已能独立完成招聘外邀、面试安排等全流程任务

- 为应对本地设备算力不足的问题,云端智能体成为新方向,阿里云推出的"无影AgentBay"旨在提供开箱即用的智能体云基础设施

🔗 关联思维如何成为多模态AI Agent的"商业大脑"

关联思维的本质是发现看似不相关事物之间的内在联系,这正是多模态AI Agent最需要的能力。当AI Agent能够同时处理文本、图像、语音、传感器数据时,关联思维从"数据分析方法"升级为"商业重构引擎"。

关联思维赋予AI Agent三大商业重构能力:

1. 跨模态关联推理能力

- 传统关联规则只能分析结构化数据,而多模态AI Agent可以同时分析客户对话录音(语音)、店面监控视频(视觉)、交易记录(文本)和社交媒体情绪(文本)

- 例如:通过分析客户在店内的行走路径(视觉)与最终购买决策(交易数据)的关联,优化商品陈列;结合客服对话情绪分析(语音)与客户流失率(数据)的关联,提前干预高风险客户

2. 动态场景自适应能力

- 单一关联规则面对概念漂移时需要人工更新,而多模态AI Agent可以实时感知环境变化并自主调整关联策略

- 工业AI Agent正在改变游戏规则:黑湖科技的Agent能自动解析CAD图纸、生成工艺路径,将工艺准备时间缩短60%;恒远科技探索的Multi-Agent智能协作网络,能让多个Agent在百毫秒内响应突发订单或设备异常

3. 多智能体协同决策能力

- 单个AI Agent的智能有限,但通过关联思维连接的Agent网络可以实现"1+1>2"的群体智能

- 例如:销售Agent发现某产品销量异常,自动触发供应链Agent检查库存,同时通知生产Agent调整排期,三个Agent基于共享的关联规则库协同决策,无需人工干预

🏢 行业重构:从"单点优化"到"生态重构"

多模态AI Agent正在重塑各行业的竞争规则,其核心是通过关联思维重新定义价值创造逻辑。

制造业:从"自动化"到"自主进化"

- 传统智能制造关注单个环节的自动化,而多模态AI Agent构建的"工业大脑"能够自主发现设备传感器数据、工单数据、供应链数据之间的隐藏关联

- 实践案例:某制造企业通过多Agent系统,自主发现了设备振动频率(传感器数据)与原材料批次(供应链数据)之间的关联,提前一周预测设备故障,并将此规则共享给供应商Agent,优化原材料采购策略

零售业:从"人货场"到"感知-决策-行动"闭环

- 多模态AI Agent重新定义零售三要素:通过视觉Agent分析客流热力图,语音Agent收集顾客反馈,推荐Agent基于跨渠道关联实时调整营销策略

- 数据证明:淘宝天猫的"AIGX"体系通过多模态分析,使商品点击率提升10%,月均生成2亿张营销图片;百联股份的AI客流系统通过关联分析,使AI发券转化率提升15%

金融风控:从"事后检测"到"事前预警"

- 传统风控模型基于历史规则,而多模态AI Agent能够关联分析交易流水、用户行为序列、社交媒体情绪等多源信息,提前识别欺诈模式演变

- 突破性应用:某银行通过视觉Agent分析ATM监控视频(异常行为模式)+ 交易Agent监测实时流水 + 舆情Agent扫描黑暗网络信息,构建了动态更新的反欺诈关联网络,将欺诈识别准确率提升20个百分点

🧠 技术架构:关联思维如何融入AI Agent技术栈

多模态AI Agent的技术架构正在从"工具链堆砌"向"认知架构设计"演进,关联思维成为连接各技术组件的神经网络。

2024-2025年AI技术知识体系呈现清晰的层次架构:

关联思维在技术栈中的具体体现:

在数学基础层,关联思维需要概率论与统计学、信息论等数学工具的支持,特别是贝叶斯推理为多源信息关联提供了理论框架。

在核心模型层,Transformer架构的自注意力机制本质就是一种关联发现机制,而图神经网络(GNN)直接建模实体间的关系网络,为关联思维提供了天然的技术载体。

在系统部署层,MLOps体系需要支持关联规则的持续学习和动态更新,确保AI Agent能够随环境变化自主优化决策逻辑。

💡 企业实施路径:从"项目制"到"平台化"

企业要拥抱多模态AI Agent时代,需要从根本上改变AI实施方法论。

战略定位三重转变:

- 从"AI项目"到"AI生态":不再追求单个项目的ROI,而是构建支持多Agent协同的平台架构

- 从"数据孤岛"到"关联网络":打破部门边界,构建跨域数据关联体系,为AI Agent提供燃料

- 从"人力驱动"到"人机协同":重新设计组织架构,人类员工专注于创造性工作,重复性关联分析交给AI Agent

技术实施四阶段路线图:

阶段一:关联能力基础建设(3-6个月)

- 构建统一数据湖,打通各业务系统数据

- 部署基础的多模态大模型,建立跨模态理解能力

- 在单一场景验证关联思维的价值(如客服质效提升)

阶段二:单点Agent试点(6-12个月)

- 选择高价值场景部署专用AI Agent

- 建立关联规则库,训练Agent的跨模态推理能力

- 例如:零售企业的智能营销Agent,关联分析客户历史购买、实时位置、社交媒体兴趣

阶段三:多Agent协同网络(12-24个月)

- 部署多个专业Agent,建立Agent间的通信协议

- 设计Agent协同机制,实现群体智能决策

- 例如:制造企业的生产Agent、供应链Agent、质量Agent协同优化全流程

阶段四:自主进化生态(24个月以上)

- 建立Agent自主学习和规则进化机制

- 构建开放的Agent平台,支持内外部Agent接入

- 实现商业系统的自我优化和持续进化

🚀 未来展望:关联思维驱动的商业新范式

当多模态AI Agent成为商业标配,关联思维将从"竞争优势"变为"生存必需品"。未来的商业竞争不再是单个企业间的竞争,而是关联网络与关联网络之间的竞争。

三个关键趋势正在加速这一未来:

关联密度决定商业价值:企业的价值不再取决于资源规模,而是其构建和利用关联网络的能力。能够快速发现并利用新关联的企业将获得指数级增长优势。

自主决策成为常态:随着AI Agent推理能力的提升,越来越多的运营决策将由Agent自主完成。人类管理者的角色从"决策者"转变为"规则设计者和异常处理者"。

商业边界重新定义:关联思维使得跨行业、跨领域的商业创新成为可能。例如,医疗健康数据与保险精算模型的关联,零售消费行为与金融信用评估的关联,都将催生全新的商业模式。

最终的赢家将是那些最早理解并掌握"关联思维+多模态AI Agent"这一新范式的企业。它们不仅能用AI优化现有业务,更能用关联思维重新定义行业规则,构建难以复制的竞争壁垒。

关联思维正在从后台的分析工具走向前台的商业引擎,多模态AI Agent则为这一转变提供了技术实现路径。当你的企业能够用关联思维连接一切数据、一切流程、一切决策时,你就掌握了未来商业的通行证。

恭喜你! 坚持读到这里的你,已经不再是AI领域的旁观者,而是手握完整商业落地地图的实战派。为了让你在1周内把前面16章的理论变成可演示的MVP,我为你准备了这份专属资源包。

🎁 三大核心资源:从理论到实战的"加速器"

1. 真实行业数据集(告别玩具数据)

- 电商交易数据集:包含50万条匿名用户交易记录,覆盖3C、服装、食品等品类,附带用户画像标签

- 金融交易流水:脱敏后的银行信用卡交易数据,包含正常消费与标记的欺诈交易模式

- 制造业设备传感器数据:真实产线3个月的设备运行参数与工单记录对应表

- 医疗健康时序数据:可穿戴设备采集的心率、步数数据与健康事件记录

每个数据集都包含:

- 📊 数据字典与业务含义解释

- 🔍 典型业务问题清单(直接对应第5-8章案例)

- ⚠️ 数据质量说明(真实数据的典型问题与处理建议)

2. 开箱即用的代码库 基于Python的完整项目框架,包含:

# 关联规则实战框架

├── data_quality/ # 数据质量六维诊断

│ ├── completeness_check.py

│ ├── consistency_validator.py

│ └── outlier_detection.py

├── algorithm_library/ # 算法兵器库

│ ├── traditional/ # Apriori、FP-Growth等传统算法

│ ├── deep_learning/ # 关联规则+GNN融合模型

│ └── real_time/ # 流式处理版本

├── business_cases/ # 行业案例直接复现

│ ├── ecommerce/ # 电商购物篮分析完整流程

│ ├── finance/ # 金融反欺诈规则引擎

│ └── manufacturing/ # 设备故障预警模型

└── visualization/ # 老板能看懂的可视化模板

├── one_page_story.py # 一页纸商业故事生成器

└── interactive_dashboard/ # 交互式看板

代码库特色:

- 🚀 每个函数都有详细的业务场景注释

- 📈 内置性能监控与ROI计算模块

- 🔄 支持从POC到生产环境的平滑过渡

3. 一页式PPT模板库 直接套用的汇报模板,涵盖:

技术向CTO汇报版

- 技术选型决策矩阵可视化

- 算法性能对比图表模板

- 系统架构图与扩展路线

商业向CEO汇报版

- ROI计算与敏感性分析模板

- 竞争对手对比雷达图

- 风险应对策略矩阵

项目进展汇报版

- 里程碑达成情况追踪

- 资源投入与产出对比

- 下一步行动计划表

💡 如何最大化利用这些资源?

第一周:快速验证价值

- 选择最匹配的业务场景(参考第5-8章)

- 运行对应的案例代码(只需修改数据路径)

- 生成第一版分析报告(使用PPT模板)

实战建议:

- 先从小的数据子集开始,快速验证流程

- 重点关注业务逻辑而非技术细节

- 用可视化结果与业务方沟通,收集反馈

进阶路径:

- 在第2周尝试替换自己的业务数据

- 第3周开始优化算法参数和业务规则

- 第4周形成完整的商业案例文档

🚀 特别提醒:避免常见的"资源浪费"陷阱

陷阱1:追求技术完美而延迟交付

- ✅ 正确做法:先用现成代码跑通端到端流程,再逐步优化

- ❌ 错误做法:花两周时间重构代码,却没有任何业务输出

陷阱2:试图一次性解决所有问题

- ✅ 正确做法:聚焦一个具体业务问题,做出可量化的价值证明

- ❌ 错误做法:同时启动多个复杂项目,资源分散难以见效

陷阱3:忽视业务方的理解成本

- ✅ 正确做法:用模板中的可视化直接展示业务价值

- ❌ 错误做法:直接展示技术指标和算法复杂度

📞 需要更多帮助?

这些资源的设计理念是"开箱即用",但如果你在具体落地过程中遇到问题:

- 技术实现问题:参考第2-4章的技术地基部分

- 业务场景选择:重温第5-8章的行业案例

- 老板沟通挑战:直接使用第9章的可视化叙事模板

- 项目推进障碍:第12章的企业级落地路线图有详细避坑指南

记住,这些资源的价值不在于技术本身,而在于它们能帮你快速证明AI的商业价值。当你用一周时间做出第一个可演示的MVP时,你就已经超越了90%的"纸上谈兵"者。

现在,就去打开那个代码库,选择最匹配的业务场景,开始你的第一个AI实战项目吧!