主题: 技术对比

核心摘要

异步与并发

aiohttp作为原生异步库,并发性能最强;官方SDK需封装或结合异步库才能实现高并发。

批量处理

OpenAI的批量API在处理大规模请求时效率最高,DashScope次之,aiohttp需自行实现。

选择建议

根据场景选择:OpenAI SDK(易用)、aiohttp(高性能)、DashScope(阿里云生态)。

在Python环境下,异步处理和高并发调用是优化大模型API使用效率的关键技术。本文将对阿里云DashScope SDK、OpenAI Python SDK以及异步HTTP客户端库aiohttp进行全面对比分析,从异步处理架构、并发性能指标、API限流机制和批量处理能力以及代码复杂度与易用性四个维度进行评估,帮助开发者根据实际需求选择最适合的工具。

1. DashScope Python SDK

DashScope作为阿里云推出的一站式大模型API服务平台,其Python SDK主要通过对象池优化来提高并发性能。DashScope Python SDK通过SpeechSynthesizerObjectPool实现对象池管理,支持预先创建WebSocket连接并复用,从而减少频繁创建连接的开销。

关键结论 (Key Takeaway)

DashScope SDK的核心优化在于对象池(Object Pool),它通过复用预先创建的WebSocket连接,显著降低了高频次调用时的连接建立开销和首包延迟。

from dashscope audio.tts_v2 import SpeechSynthesizerObjectPool

# 创建对象池

synthesizer_object_pool = SpeechSynthesizerObjectPool(max_size=20)

# 从池中获取对象

speech_synthesizer = synthesizer_object_pool.borrow_synthesizer(

model='cosyvoice-v3-flash',

voice='longanyang',

seed=12382,

callback=synthesizer_callback

)

# 进行语音合成

response = speech_synthesizer.call(...)

# 归还对象到池中

synthesizer_object_pool返还(speech_synthesizer)

DashScope Python SDK的异步处理能力依赖底层HTTP库实现,官方文档中未明确提供内置的异步接口。这意味着开发者需要自行结合aiohttp或httpx等异步HTTP客户端库来实现真正的异步请求处理。虽然DashScope Python SDK没有直接提供异步接口,但其对象池优化可以显著降低首包延迟,提高资源利用率。

2. OpenAI Python SDK

OpenAI的Python官方SDK (openai-python)目前不支持内置的异步接口,主要提供同步API调用。要实现异步处理,开发者通常有两种选择:

- 使用社区维护的AsyncOpenAI库:这是一个第三方异步封装库,简化了异步调用流程。

- 手动封装异步请求:结合

aiohttp或httpx等异步HTTP客户端库,自行实现异步逻辑。

以下是使用AsyncOpenAI库的异步调用示例:

import asyncio

from openai import AsyncOpenAI

async def main():

client = AsyncOpenAI(api_key="sk-...")

response = await client响应.completions.create(

model="gpt-3.5-turbo",

prompt="请用通俗语言解释深度学习",

)

print(response.choices[0].message.content)

asyncio.run(main())

3. aiohttp

aiohttp是Python中一个原生异步HTTP客户端/服务器框架,基于标准库asyncio构建,提供高性能的异步HTTP请求能力。它通过ClientSession和连接池机制管理HTTP连接,支持WebSocket和HTTP/2协议。aiohttp的异步处理能力体现在:

- 事件循环模型:利用Python的asyncio事件循环,实现非阻塞的IO操作

- 连接池管理:

ClientSession内置连接池,复用HTTP连接,减少资源开销 - 信号量控制:通过

asyncio.Semaphore限制并发请求数,避免过度并发 - 协程调度:支持并发执行多个请求,充分利用CPU资源

import aiohttp

import asyncio

async def fetch(session, url):

async with session.get(url) as response:

return await response.text()

async def main():

async with aiohttp.ClientSession() as session:

tasks = []

for i in range(100):

tasks.append(fetch(session, f"https://api.example.com/data/{i}"))

results = await asyncio.gather(*tasks)

return results

loop = asyncio.get_event_loop()

results = loop.run_until_complete(main())

4. 架构对比分析

从架构上看,aiohttp作为纯异步HTTP库提供了最底层的异步处理能力,而DashScope和OpenAI的SDK则提供了针对各自平台API的封装,但异步处理能力受限于底层HTTP库的实现。

架构洞察 (Architectural Insight)

aiohttp 提供了最底层、最灵活的异步能力,而官方SDK(DashScope/OpenAI)则是在特定API之上提供了一层易用的封装,其异步性能最终依赖于所选底层HTTP库(如aiohttp)的实现。

1. DashScope Python SDK并发性能

DashScope Python SDK的并发性能主要受以下因素影响:

- 对象池大小:推荐设置为峰值并发数的1.5-2倍,但不应超过账户QPS限制

- 连接池配置:Python版本未明确提供连接池参数,可能需要依赖底层HTTP库的连接池设置

- 阿里云账户配额:每个主账号默认的QPS限制为3(如语音合成服务)

- 连接建立时间:通过对象池预先建立WebSocket连接,可显著降低首包延迟

在实际应用中,DashScope Python SDK的并发性能受限于其对象池配置和阿里云账户配额。当处理大量请求时,需要合理设置对象池大小,并结合异步HTTP库(如aiohttp)来实现真正的高并发。

2. OpenAI Python SDK并发性能

OpenAI API的并发性能主要受以下因素限制:

- 请求每分钟限制(RPM):默认值为3000,但会因账户层级不同而变化

- 令牌每分钟限制(TPM):不同模型有不同的TPM限制

- 批量处理能力:支持通过批量API提交最多50,000个请求/文件

- 每批次处理量:单个批量请求最多可包含2048个文本

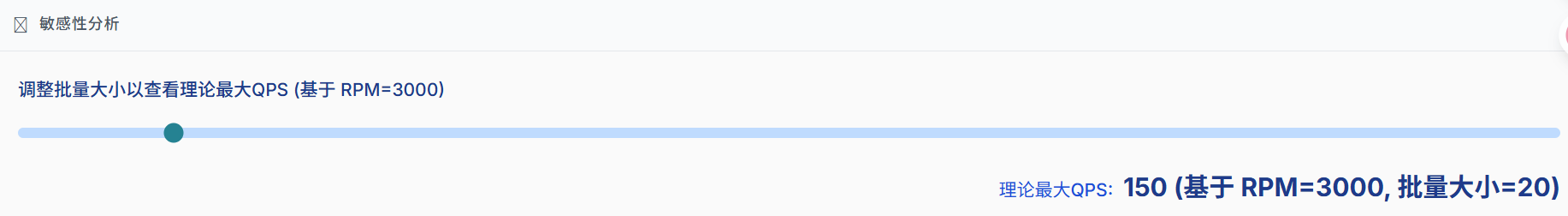

当使用异步库(如aiohttp或AsyncOpenAI)时,OpenAI API的并发性能计算公式为:理论最大QPS = RPM / 批量大小。例如,若RPM为3000,批量大小为20,则理论QPS约为150。

敏感性分析

调整批量大小以查看理论最大QPS (基于 RPM=3000)

理论最大QPS:150 (基于 RPM=3000, 批量大小=20)

3. aiohttp并发性能

aiohttp作为专门的异步HTTP客户端库,提供了更高的并发性能:

- 默认连接池大小:100个连接

- 最大并发请求数:受信号量控制,可配置为任意值

- 无API级限流:需要开发者自行实现限流策略

- 高吞吐量:在优化配置下,可实现数千QPS的并发能力

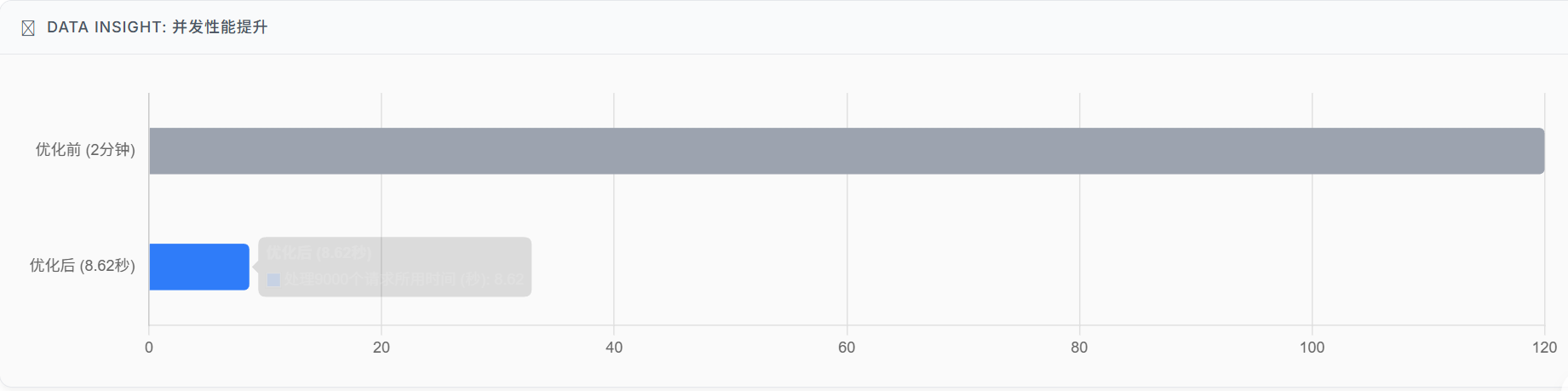

材料[27]中的实验证明,使用异步代码优化HTTP连接后,9000个请求的处理时间从2分钟减少到8.62秒,性能提升超过14倍,这主要归功于aiohttp的异步并发能力。

Data Insight: 并发性能提升

4. 并发性能对比

在并发性能方面,aiohttp作为专门的异步HTTP库提供了最强大的并发能力,但需要开发者自行处理API特定的限流和批量处理逻辑。OpenAI SDK通过批量API可以实现较高的并发性能提升,而DashScope Python SDK的并发性能则受限于其对象池配置和阿里云账户配额。

1. 限流机制对比

DashScope Python SDK:

- 无内置限流功能:需要开发者自行实现限流机制

- 依赖阿里云账户配额:每个主账号默认有RPM和QPS限制

- 对象池大小限制:对象池大小不应超过账户QPS限制

- 手动控制:可通过信号量或令牌桶算法控制并发请求

OpenAI Python SDK:

- 官方强制RPM/QPS限制:默认RPM为3000,但会因账户层级不同而变化

- 批量API限流:批量API同样受RPM/TPM限制,但可通过分批次处理提高效率

- 社区解决方案:如

aiolimiter等库提供令牌桶算法实现 - 限流策略:材料[39]建议在达到API限制时,回退和重试是应对策略

aiohttp限流实现:

- 信号量控制:通过

asyncio.Semaphore限制最大并发请求数 - 令牌桶算法:可通过

aiolimiter等第三方库实现 - 固定窗口/滑动窗口:支持多种限流模型,如固定窗口、滑动窗口、令牌桶等

- 自定义灵活性:可以根据API限制灵活调整限流参数

2. 批量处理能力对比

DashScope Python SDK:

- 有限的批量支持:仅部分API(如文本嵌入)支持批量异步处理

- 手动分批次:文本生成等API需要开发者手动分批次处理

- 文件上传方式:通过上传文件触发批量任务,返回结果URL

- 适用场景:适合特定API的批量处理,如文本嵌入等

OpenAI Python SDK:

- 完善的批量API:支持JSONL格式文件批量提交,最多50,000个请求/文件

- 分步处理机制:通过

client.files.create上传任务文件,再通过client.batches.create创建批量任务 - 结果查询方式:批量任务完成后,通过

client.batches.retreive查询结果 - 适用场景:适合大规模非实时任务处理,如文档批量摘要、用户评论情感分析等

aiohttp批量处理能力:

- 无内置批量API支持:需要开发者自行实现批量请求处理逻辑

- 高性能并发请求:通过事件循环和连接池,可以高效并发处理大量请求

- 任务分片机制:需要开发者实现请求分片和结果聚合逻辑

- 适用场景:适合需要完全自定义批量处理逻辑的场景

# OpenAI批量API示例

from openai import OpenAI

client = OpenAI(api_key="sk-...")

# 1. 上传任务文件

with open("requests.jsonl", "rb") as f:

file_response = client.files.create(

file=f,

purpose="batch"

)

# 2. 创建批量任务

batch_response = client.batches.create(

input_file_id=file_response.id,

endpoint="/v1/chat/completions",

completion_window="24h",

)

# 3. 查询任务状态

while batch_response.status != "completed":

batch_response = client.batches.retreive(batch_response.id)

await asyncio.sleep(30) # 每30秒检查一次

# 4. 下载结果文件

with open("results.jsonl", "wb") as f:

response = client.files.download(file_id=batch_response.output_file_id)

f.write(response.content)

3. 批量处理效率对比

OpenAI的批量API在处理大规模请求时具有明显优势,特别是当请求量超过数千时,其文件上传-处理-下载的模式可以显著提高效率。然而,这种优势需要开发者处理文件上传和下载的额外开销。而aiohttp虽然在单个请求处理上性能最佳,但缺乏内置的批量任务管理机制,需要开发者自行实现。

1. 代码复杂度分析

DashScope Python SDK:

- 同步接口为主:官方文档中的示例代码多为同步调用

- 对象池配置:需要额外代码配置和管理对象池

- 异步支持:需要结合底层HTTP库实现异步,增加代码复杂度

- 依赖管理:需要安装

dashscope和SpeechSynthesizerObjectPool等依赖

OpenAI Python SDK:

- 同步接口为主:官方SDK提供同步API调用

- 异步封装:使用第三方库(如AsyncOpenAI)可简化异步调用

- 批量API支持:提供完整的批量API接口,使用相对简单

- 文档支持:中文社区有较为完善的文档和示例

aiohttp:

- 异步原生支持:基于asyncio的完整异步HTTP客户端

- 连接池管理:内置连接池,使用相对简单

- 限流实现:需要开发者自行实现限流策略,增加代码复杂度

- 通用性:适用于任何HTTP API,无需特定SDK知识

2. 易用性对比

3. 选择建议

对于简单异步需求:

- 如果主要调用OpenAI API,推荐使用AsyncOpenAI库,其提供了简洁的异步接口,代码复杂度最低。

- 示例代码只需几行即可实现异步调用,且社区文档支持较好。

对于高并发需求:

- 如果需要处理数千甚至上万QPS的并发请求,推荐使用aiohttp作为基础HTTP客户端,结合自定义的限流策略。

- 虽然需要额外代码实现限流和批量处理逻辑,但其原生异步支持和高性能连接池可以提供最佳的并发性能。

对于特定平台集成:

- 如果项目主要使用阿里云服务,且需要调用语音合成等特定API,推荐使用DashScope Python SDK。

- 其对象池优化可以降低首包延迟,提高资源利用率,但需要结合异步库实现真正的高并发。

对于大规模批量处理:

- 如果需要处理数十万级别的请求,推荐使用OpenAI的批量API。

- 虽然需要处理文件上传和下载的额外步骤,但其批量处理机制可以最大化利用API配额,提高整体处理效率。

1. 高并发API调用优化策略

DashScope Python SDK优化策略:

- 合理配置对象池大小,通常设置为峰值并发数的1.5-2倍

- 结合aiohttp等异步库实现真正的高并发请求

- 避免对象池大小超过连接池大小,防止请求阻塞

- 实现完善的错误处理和重试机制

# DashScope与aiohttp结合的异步调用示例

import asyncio

from dashscope音频.tts_v2 import SpeechSynthesizerObjectPool

import aiohttp

async def process_request(session, synthesizer, text):

# 使用DashScope的Synthesizer进行处理

response = synthesizer.call(text)

# 使用aiohttp进行其他异步操作

async with session.get('https://api.example.com/translate', params={'text': text}) as resp:

return await resp.json()

async def main():

# 创建DashScope对象池

synthesizer_pool = SpeechSynthesizerObjectPool(max_size=20)

# 创建aiohttp客户端会话

async with aiohttp.ClientSession() as session:

tasks = []

for text in texts:

# 从对象池借用Synthesizer

synthesizer = synthesizer_pool.borrow_synthesizer(

model='cosyvoice-v3-flash',

voice='longanyang'

)

# 创建异步任务

task = asyncio.create_task(process_request(session, synthesizer, text))

tasks.append(task)

# 等待所有任务完成

results = await asyncio.gather(*tasks)

# 归还所有Synthesizer到对象池

for synthesizer in synthesizers:

synthesizer_pool返还(synthesizer)

asyncio.run(main())

2. OpenAI异步调用优化策略

OpenAI异步调用优化策略:

- 结合批量API和异步请求,最大化利用API配额

- 实现令牌桶限流算法,避免触发API限制

- 使用

asyncio.gather并行处理多个异步任务 - 添加自动重试机制处理暂时性错误

# OpenAI异步调用示例

from openai import AsyncOpenAI

import asyncio

import aiolimiter

async def process_request(client, limiter, prompt):

async with limiter:

response = await client响应.completions.create(

model="gpt-3.5-turbo",

prompt=prompt,

)

return response

async def main():

# 初始化客户端

client = AsyncOpenAI(api_key="sk-...")

# 初始化令牌桶限流器(3000 RPM)

limiter = aiolimiter rate_limit.RateLimiter(3000, 60)

# 创建异步任务列表

tasks = []

for prompt in prompts:

task = asyncio.create_task(process_request(client, limiter, prompt))

tasks.append(task)

# 并行执行任务

results = await asyncio.gather(*tasks)

return results

asyncio.run(main())

3. 高并发场景性能对比

在高并发场景下,三者的性能表现存在显著差异:

- DashScope Python SDK:在处理语音合成等特定API时具有优势,但需要合理配置对象池和连接池,否则并发性能受限

- OpenAI Python SDK:结合AsyncOpenAI和批量API时,可以实现接近API配额上限的并发性能

- aiohttp:在纯HTTP并发处理上性能最佳,但需要开发者自行处理API特定的限流和批量逻辑

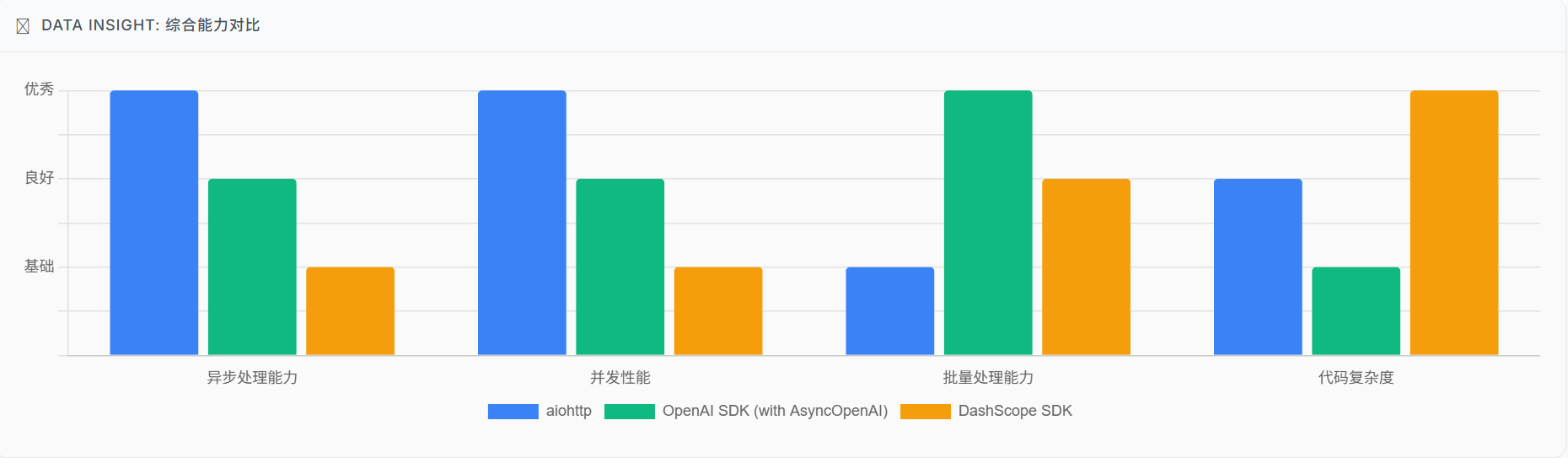

1. 性能对比结论

– 异步处理能力:aiohttp > OpenAI(使用AsyncOpenAI) > DashScope(需结合异步库)

– 并发性能:aiohttp > OpenAI(使用AsyncOpenAI) > DashScope

– 批量处理能力:OpenAI > DashScope(部分API) > aiohttp(需自行实现)

– 代码复杂度:DashScope(需管理对象池) > aiohttp(需理解asyncio) > OpenAI(使用AsyncOpenAI)

Data Insight: 综合能力对比

2. 最佳实践建议

根据应用场景选择:

- 文本生成/问答场景:优先使用OpenAI Python SDK结合AsyncOpenAI库,提供最佳的API支持和异步处理能力

- 语音合成/特定API调用:使用DashScope Python SDK,结合aiohttp实现高并发

- 通用高并发需求:直接使用aiohttp,灵活控制并发参数,适用于任何HTTP API调用

根据并发级别选择:

- 中小并发(<100 QPS):使用OpenAI Python SDK或DashScope Python SDK的同步接口,简单直接

- 中等并发(100-500 QPS):使用OpenAI Python SDK结合AsyncOpenAI库,或DashScope Python SDK结合aiohttp

- 高并发(>500 QPS):优先使用aiohttp,结合完善的限流和批量处理策略

根据代码复杂度接受度选择:

- 低代码复杂度:使用AsyncOpenAI库封装OpenAI API异步调用,或使用DashScope Python SDK的同步接口

- 中等代码复杂度:使用aiohttp手动封装OpenAI或DashScope的API调用

- 高代码复杂度:完全自定义异步处理逻辑,精细控制每个请求参数

3. 性能优化通用策略

无论选择哪个工具,以下通用策略可以帮助优化异步处理和并发性能:

- 合理配置连接池:根据实际需求设置连接池大小,通常为峰值并发数的1.5-2倍

- 实现令牌桶限流:避免触发API的RPM/TPM限制,确保服务稳定性

- 批量处理:尽可能将多个请求打包为一个批量请求,减少API调用次数

- 错误处理与重试:实现指数退避重试机制,处理暂时性错误

- 结果缓存:对常见请求实现缓存机制,减少重复API调用

- 任务拆分:将大规模任务拆分为多个子任务并行处理

- 监控与调优:实时监控API调用情况,根据实际负载动态调整并发参数

在Python环境下,异步处理和高并发调用是优化大模型API使用效率的关键技术。开发者应根据实际应用场景、并发需求级别和代码复杂度接受度,选择最适合的工具组合。对于大多数应用,结合官方SDK(如OpenAI或DashScope)和异步HTTP库(如aiohttp)是平衡易用性和性能的最佳方案。在处理大规模请求时,OpenAI的批量API提供了最便捷的解决方案,而aiohttp则为需要极致并发性能的应用提供了底层支持。

最终,没有"最好"的工具,只有"最适合"当前应用场景的工具组合。开发者应根据实际需求,灵活选择和组合这些工具,以实现最佳的API调用效率和用户体验。