本文还有配套的精品资源,点击获取

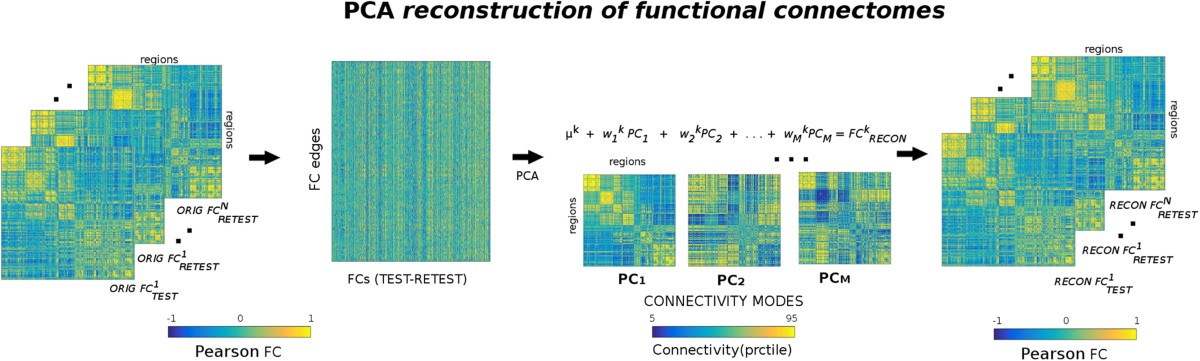

简介:功能磁共振成像(FMRI)是一种监测大脑活动的技术,通过分析血流变化来推断神经活动的位置。本示例将介绍如何运用主成分分析(PCA)技术来处理FMRI数据,旨在发现隐藏模式并减少数据维度。在MATLAB环境中,我们逐步进行数据预处理、标准化、计算协方差矩阵、提取特征值和向量、选择主成分、投影数据,并进行解释和可视化。此方法不仅简化了数据处理,还帮助研究者更精确地理解大脑功能连接的复杂性。

功能磁共振成像(fMRI)是一种利用磁共振成像技术检测大脑活动的方法。其原理是基于血氧水平依赖(BOLD)信号的变化,当大脑的某一部位活动增强时,该区域的血氧浓度会上升,通过检测这些变化可以推断出大脑中的活动区域。

fMRI在医学研究和临床诊断中有着广泛的应用,特别是在神经科学研究领域,如研究大脑的工作记忆、感知和情感等。它能够提供与特定认知功能相关联的脑区活动的详细信息。

随着技术的不断进步,fMRI的应用不断扩展。例如,高场强的MRI设备和更为复杂的分析方法的发展,使得fMRI能够更精细地描绘大脑功能网络,并为诸如精神疾病诊断、认知衰退等临床问题提供新的视角。

fMRI技术正变得越来越重要,因此,掌握相关数据分析方法,如主成分分析(PCA),对于理解大脑复杂活动模式至关重要。在接下来的章节中,我们将深入探讨PCA的基本原理及其在fMRI数据处理中的应用。

2.1 PCA数学模型概述

2.1.1 数据降维的必要性

随着技术的发展,我们能够收集到的数据量越来越大。但是,并不是所有的数据都对我们的分析目标有帮助。有些数据可能是冗余的,有些可能是噪声。数据降维就是把数据从高维空间映射到低维空间的过程。它不仅可以减少计算量,加快算法的执行速度,而且还可以提高分析的准确性,降低过拟合的风险。

在实际应用中,数据降维最典型的应用就是PCA。PCA可以找到最重要的几个特征,这些特征能够尽可能多的保留原始数据的信息。同时,通过去除不必要的特征,我们可以降低模型的复杂度和过拟合的风险。

2.1.2 PCA的统计学意义

PCA是基于协方差矩阵分解的线性变换。其核心思想是将数据点投影到能解释数据中大部分变异性的一组正交坐标轴上。在统计学上,这种方法相当于找到数据的主成分,也就是方差最大的方向。

在高维空间中,数据点可能分散在多个方向上,但并非所有方向都是重要的。通过PCA,我们可以找出这些方向中最重要的几个,也就是那些具有最大方差的方向。这个过程就是通过计算数据的协方差矩阵,然后对其特征值和特征向量进行排序和选择来实现的。

2.2 PCA的算法步骤

2.2.1 数据中心化处理

在进行PCA之前,第一步通常是对数据进行中心化处理,即将数据的均值置为0。这是因为PCA是通过协方差矩阵来进行的,而协方差矩阵描述的是变量间的变动关系。如果数据没有中心化,那么数据的均值会对协方差矩阵产生影响,导致分析的结果无法准确反映变量间的变动关系。

数据中心化的方法非常简单,就是将每个变量的平均值从其所有观测值中减去。通过这种处理,数据的中心点将位于原点,这有助于后续的数学计算。

import numpy as np

# 假设data是一个m行n列的numpy数组,代表m个样本的n维数据

data_mean = np.mean(data, axis=0)

centered_data = data - data_mean

2.2.2 协方差矩阵的计算

中心化处理后,接下来的步骤是计算数据的协方差矩阵。协方差矩阵是一个对称矩阵,其每一个元素表示两个变量之间的协方差。协方差是衡量两个变量线性相关程度的指标,正值表示正相关,负值表示负相关,而零值则表示两个变量不相关。

为了计算协方差矩阵,我们需要使用以下公式:

$$ Sigma = frac{1}{n-1} (X – bar{X})^T (X – bar{X}) $$

其中,$Sigma$ 是协方差矩阵,$X$ 是中心化后的数据矩阵,$bar{X}$ 是数据的均值向量,$n$ 是样本数量。

# 计算协方差矩阵

cov_matrix = np.cov(centered_data.T) # 转置中心化后的数据,使每个样本成为一列

2.2.3 特征值和特征向量的提取

计算得到协方差矩阵后,下一步就是提取特征值和特征向量。特征值和特征向量是PCA的核心,它们共同构成了PCA变换的基。特征值表示对应特征向量方向上的数据方差大小,特征向量则是数据在该方向上的投影方向。

在Python中,我们可以使用NumPy库的 eig 函数来计算协方差矩阵的特征值和特征向量。

# 计算特征值和特征向量

eigenvalues, eigenvectors = np.linalg.eig(cov_matrix)

特征值按照从大到小的顺序排列,与之对应的特征向量也按照相同的顺序排列。在PCA中,我们通常按照特征值的大小来选择主成分。特征值最大的特征向量对应的方向是数据中方差最大的方向,因此选择最大的几个特征值对应的特征向量作为主成分,可以最大化保留原始数据的信息。

3.1.1 fMRI数据预处理的重要性

在进行功能磁共振成像(fMRI)数据的分析之前,预处理是至关重要的一步。预处理的目的是为了提高数据质量,去除不必要的噪声,使后续的分析更加准确。fMRI数据的预处理通常包括头动校正、空间标准化、空间平滑、时间滤波和去线性趋势等步骤。

头部运动会导致图像失真,影响数据分析的结果。因此,需要对原始fMRI数据进行头动校正,确保每个时间点的图像相对于参考图像处于相同的空间位置。空间标准化则是为了将个体的大脑图像映射到一个标准的空间模板上,从而可以进行群体间的比较。空间平滑通常用来减少图像噪声,提高信噪比。

时间滤波可以去除一些不需要的低频或高频信号,保留神经活动相关的频率成分。而去线性趋势则是为了消除扫描过程中由于设备或生理原因导致的信号漂移。

3.1.2 常用数据预处理软件介绍

市面上存在多种工具和软件用于fMRI数据的预处理,如SPM(Statistical Parametric Mapping)、AFNI(Analysis of Functional NeuroImages)和FSL(FMRIB Software Library)。这些软件都提供了一系列预处理的功能模块,并广泛应用于学术研究中。

SPM软件包是基于MATLAB平台开发的,它提供了从数据预处理到统计分析的完整工具链。AFNI则是一个包含多种图像处理功能的C语言库。FSL是一个集成在Linux环境下的软件包,它同样提供了强大的图像处理功能。

在实际应用中,研究者可以根据自己的需求选择合适的工具,并且很多情况下会综合使用多种工具来达到最好的预处理效果。

3.2.1 数据标准化的目的和方法

数据标准化是将数据按比例缩放,使之落入一个小的特定区间。在fMRI数据分析中,数据标准化的目的通常是减少不同体素(Voxel,相当于体内的像素)信号强度的量纲影响和避免因为数值范围过大而导致的计算不稳定。

常用的数据标准化方法包括Z分数标准化和最小-最大标准化。Z分数标准化会将数据转换为均值为0,标准差为1的分布,公式为:

Z = (X - μ) / σ

其中,X是原始数据,μ是数据的均值,σ是数据的标准差。最小-最大标准化会将数据缩放到[0, 1]区间:

X' = (X - X_min) / (X_max - X_min)

其中,X’是标准化后的数据,X_min和X_max分别是原始数据的最小值和最大值。

3.2.2 数据中心化对PCA的影响

数据中心化是将数据的均值调整为零的过程,它对PCA的影响至关重要。中心化确保了数据在主成分分析中以原点为中心展开,使得协方差矩阵可以更准确地捕捉数据的结构。

在PCA中,中心化后的数据的均值为零,可以确保在特征空间中,主成分的平均贡献为零。这使得主成分能够反映数据的自然变化,而不是数据集中趋势的反映。没有中心化的数据可能会导致主成分分析的结果受到数据量纲的影响,进而影响到后续分析的有效性。

3.3.1 协方差矩阵的定义

协方差矩阵是统计学中一个描述两个随机变量协方差的矩阵,它可以用来表示多个变量之间的相互关系。对于多变量数据集X,协方差矩阵C定义为:

C = (1 / (n - 1)) * X^T * X

其中,n是数据集中样本数量,X是中心化后的数据矩阵,X^T是X的转置矩阵。协方差矩阵的对角线元素表示各个变量自身的方差,非对角线元素表示不同变量之间的协方差。

3.3.2 协方差矩阵在PCA中的应用

在PCA分析中,协方差矩阵是计算主成分的基础。PCA通过分析协方差矩阵来识别数据中的主要变化方向。主成分是协方差矩阵的特征向量,它们按对应的特征值大小进行排序。

大的特征值对应的特征向量表示数据在该方向上的方差最大,因此被认为是最重要的方向。通过保留特征值较大的特征向量,可以在减少数据维度的同时保留大部分的信息。这就是PCA降维的基本原理。

接下来的章节将深入探讨PCA中的主成分选择和数据降维过程。

4.1.1 特征值的意义及其对PCA的贡献

在主成分分析(PCA)中,特征值和特征向量扮演着关键角色。每个特征值代表了原始数据中方差的一个量度,而相应的特征向量则指示了这个方差在多维数据空间中的方向。从数据处理的角度来看,特征值越大,对应特征向量的主成分就越能解释数据的变异。因此,那些具有大特征值的主成分对于描述数据的内在结构尤为重要。

4.1.2 特征向量的选择和解释

在PCA中,特征向量的选择通常基于对应特征值的大小。一个较大的特征值意味着其对应的特征向量捕获了数据中更多的信息或方差。通常,我们按照特征值从大到小的顺序排列特征向量,然后选择前几个最重要的特征向量构成新的低维空间,即主成分空间。选择合适的特征向量数量是一个关键的决策点,它取决于我们希望降维到的维度以及数据集的特点。

4.2.1 如何选择有效的主成分

选择有效的主成分通常需要考虑以下因素:

- 累积贡献率 : 这是一个量化指标,用于确定所需主成分的数量,以达到预设的数据总方差的百分比。例如,通常我们会选择那些使得累积贡献率达到85%以上的主成分。

- 特征值大小 : 选择特征值较大的主成分,因为它们对应的方向是数据方差的主要方向。

- 数据可解释性 : 在科学和工程应用中,除了统计意义上的选择外,主成分的实际可解释性也很重要。如果一个主成分无法提供有意义的解释,则可能需要重新评估。

4.2.2 主成分分析的降维效果评估

评估PCA降维效果通常涉及以下几个方面:

- 可视化 : 对于二维或三维数据集,使用散点图等可视化工具可以直观显示降维后的效果。

- 误差分析 : 比较降维前后的数据重构误差,确保降维未丢失太多信息。

- 分类效果 : 如果数据集用于后续的分类或其他机器学习任务,评估降维前后模型的性能变化也是一个重要的评估标准。

4.3.1 数据投影的意义和方法

在PCA中,数据投影的意义在于将原始数据点映射到选定的主成分构成的新空间中。这一过程通常涉及矩阵乘法运算,其中原始数据矩阵与选定的主成分矩阵相乘。这种方法的核心是将高维数据转化为低维表示,同时尽可能保留原始数据的重要信息。

4.3.2 降维后的数据重构和误差分析

在降维后,一个重要的步骤是数据重构。这通常通过将投影后的数据点逆投影回原始高维空间来实现。通过这种方式,我们可以计算重构数据与原始数据之间的差异,进而评估降维过程引入的误差。此步骤对于理解降维的效果至关重要。

以下是一个简单的MATLAB代码示例,说明如何使用PCA进行数据投影和重构:

% 假设 A 是一个已经中心化的数据矩阵

% 计算协方差矩阵

C = A' * A / size(A, 2);

% 计算特征值和特征向量

[V, D] = eig(C);

% 保留最大的k个特征值和对应的特征向量

k = 2; % 假设我们选择两个主成分

[V, ~] = sort(diag(D), 'descend');

V = V(:, 1:k);

D = diag(D(1:k, 1:k));

% 将数据投影到主成分空间

Y = A * V;

% 重构数据

A_reconstructed = Y * V';

% 计算重构误差

error = norm(A - A_reconstructed, 'fro');

在上述代码中,我们首先计算了数据矩阵的协方差矩阵。接着,我们找到了协方差矩阵的特征值和特征向量,并按照特征值的大小对特征向量进行了排序。选择前两个特征向量后,我们将数据投影到由这两个特征向量构成的主成分空间中。随后,我们通过乘法操作重构数据,并计算原始数据和重构数据之间的Frobenius范数误差,作为误差分析的一个指标。

5.1.1 如何解释PCA结果

主成分分析(PCA)的结果解释是数据降维后获得的新变量(主成分)的含义理解和应用的关键。解释PCA结果通常涉及以下几个方面:

-

特征值和特征向量的分析 :每个主成分对应一个特征值,特征值的大小代表了该主成分解释数据变异性(方差)的多少。通常,我们按照特征值的大小对主成分进行排序,特征值越大的主成分解释数据的能力越强。特征向量则指示了数据在主成分方向上的投影方向,是原始数据的线性组合。

-

累计方差贡献率 :通过计算前k个主成分的累计方差贡献率,可以确定在多少程度上保持了原始数据的信息。通常,我们会选择那些累计方差贡献率到达某个阈值(如85%或90%)的主成分。

-

散点图和载荷图 :使用散点图展示样本在选定的主成分空间中的分布情况,用载荷图来展示各个原始变量与主成分的关系。

5.1.2 结果解释的常见误区

解释PCA结果时,有几个常见的误区需要注意:

-

过度解读 :不要过度解读主成分所代表的含义,尤其是当累计方差贡献率没有达到非常高的情况下。

-

忽略原始数据 :解释主成分时应考虑原始数据的实际意义,避免仅凭数学计算结果做出结论。

-

忽视主成分的组合 :有时单个主成分难以解释清楚,需要结合多个主成分一起理解,才能更准确地解释数据。

5.2.1 可视化的基本原则和方法

在可视化PCA结果时,基本原则是尽量清晰、准确地表达数据关系,同时避免过度复杂化:

-

简洁明了 :尽量减少图表中的元素,保持图表的简洁性,使信息一目了然。

-

颜色和标记 :合理使用颜色和标记区分不同的数据点或主成分,提高可读性。

-

交互性 :如果可能,使用交互式可视化,允许用户探索数据的不同视图。

常见的可视化方法包括:

-

散点图(Scatter Plot) :用于展示样本在主成分空间的分布情况,可以通过不同的颜色或形状区分样本所属的组别。

-

条形图(Bar Chart) :用于展示各个主成分的方差贡献率,帮助用户理解每个主成分的重要性。

-

载荷图(Loading Plot) :用于展示主成分与原始变量之间的关系。

5.2.2 PCA结果的图形化表达

以下是几种图形化表达PCA结果的方式:

5.2.2.1 散点图示例

graph TD

A[PCA散点图] --> B[样本点]

A --> C[第一主成分]

A --> D[第二主成分]

B --> E[颜色标记]

E -->|组别区分| F[组别1]

E -->|组别区分| G[组别2]

C --> H[方差解释度]

D --> I[方差解释度]

在上图中,散点图展示了样本点在第一和第二主成分构成的空间内的分布。每个点的颜色代表了不同的组别,图中还标出了主成分对应的方差解释度,帮助观察者理解数据的变异性如何被主成分捕捉。

5.2.2.2 条形图示例

graph TD

A[条形图] --> B[特征值]

B --> C[主成分1]

B --> D[主成分2]

B --> E[主成分3]

C --> F[方差贡献]

D --> F

E --> F

条形图清晰地展示了各个主成分对应的特征值大小,通过条形的长度直观显示了每个主成分的方差贡献度,使用户可以快速判断哪些主成分是重要的。

5.2.2.3 载荷图示例

graph TD

A[载荷图] --> B[变量]

B --> C[主成分1]

B --> D[主成分2]

C --> E[载荷值]

D --> E

载荷图展示了原始变量与主成分之间的关系。图中每个点代表一个变量,其在主成分轴上的位置显示了该变量在主成分上的载荷大小。通过载荷图,我们可以理解哪些原始变量对哪些主成分有较大的影响。

在进行可视化时,还可以利用一些统计软件包或编程库,如R的ggplot2、Python的matplotlib和seaborn等,它们提供了丰富的工具和接口来帮助用户创建高质量的图形。

MATLAB是一种广泛用于数学计算、数据分析、算法开发和工程绘图的高级编程语言和交互式环境。它在PCA(主成分分析)领域具有强大的应用能力,尤其在处理复杂的数学计算和数据可视化方面表现出色。本章将深入探讨MATLAB如何应用于PCA分析,并提供实战演练的示例代码。

MATLAB不仅提供了一个高效的编程平台,还拥有针对特定任务的工具箱,其中包括用于PCA分析的工具箱。

6.1.1 MATLAB在数据分析中的地位

MATLAB在数据分析领域的地位是由其强大的数学计算能力和易于使用的编程环境所确立的。它拥有大量的内置函数和工具箱,覆盖了从基础统计到高级机器学习的广泛应用。MATLAB的矩阵操作能力尤其强大,使得它非常适合于处理高维数据,如在PCA分析中的应用。

6.1.2 MATLAB中PCA相关工具箱介绍

MATLAB提供了多个工具箱来执行PCA,包括统计和机器学习工具箱。这些工具箱中的函数可以帮助用户轻松实现数据的预处理、主成分的提取和解释等。

-

pca函数:MATLAB内置的pca函数能够直接计算数据的主成分,返回主成分的得分、载荷以及解释的方差比例等。 -

biplot函数:在分析主成分后,biplot函数可以生成一个图形,以展示不同变量在主成分空间的贡献和数据点的位置。 -

pcares函数:此函数用于评估PCA模型的结果,可以帮助用户验证主成分分析的质量和结果的可解释性。

接下来,我们将通过一个MATLAB的实战演练来说明如何进行PCA分析。

6.2.1 MATLAB环境的搭建和配置

在开始之前,确保你的MATLAB环境已经安装了统计和机器学习工具箱。可以在MATLAB的命令窗口中输入以下命令来检查工具箱是否安装:

ver

6.2.2 MATLAB代码示例及其解读

以下是使用MATLAB进行PCA分析的一个简单示例。该示例将展示如何对一个随机生成的数据集执行PCA,并用图形展示结果。

% 生成一个随机数据集

data = rand(100, 5);

% 执行PCA分析

[coeff, score, latent] = pca(data);

% 打印主成分的解释方差比例

disp(diag(latent));

% 绘制主成分得分的散点图

biplot(score(:,1:2));

title('PCA Biplot of the first two principal components');

xlabel('First principal component');

ylabel('Second principal component');

该代码段首先创建了一个由100个样本点组成的5维数据集。然后,使用 pca 函数计算了数据的主成分,并提取了得分(score)和载荷(coeff)。通过 biplot 函数,我们将数据的前两个主成分以散点图的形式展示出来,可以直观地看到不同样本点在主成分空间中的分布和主要变量的贡献方向。

通过以上过程,我们不仅完成了PCA的分析,还将结果以图形的方式展示出来,这对于解释PCA结果和进一步的数据分析具有重要的意义。

在实际应用中,PCA可能需要结合其他的预处理和后处理步骤来提高结果的准确性和可靠性。例如,可能需要对数据进行标准化处理、移除噪声或考虑数据的潜在结构。通过MATLAB,可以灵活地实现这些步骤,并获得对数据更深入的理解。

本文还有配套的精品资源,点击获取

简介:功能磁共振成像(FMRI)是一种监测大脑活动的技术,通过分析血流变化来推断神经活动的位置。本示例将介绍如何运用主成分分析(PCA)技术来处理FMRI数据,旨在发现隐藏模式并减少数据维度。在MATLAB环境中,我们逐步进行数据预处理、标准化、计算协方差矩阵、提取特征值和向量、选择主成分、投影数据,并进行解释和可视化。此方法不仅简化了数据处理,还帮助研究者更精确地理解大脑功能连接的复杂性。

本文还有配套的精品资源,点击获取