.Part to Whole: Collaborative Prompting for Surgical Instrument Segmentation

从部分到整体:手术器械细分的协作性验证

2023年 发布在Arxiv

Paper Code

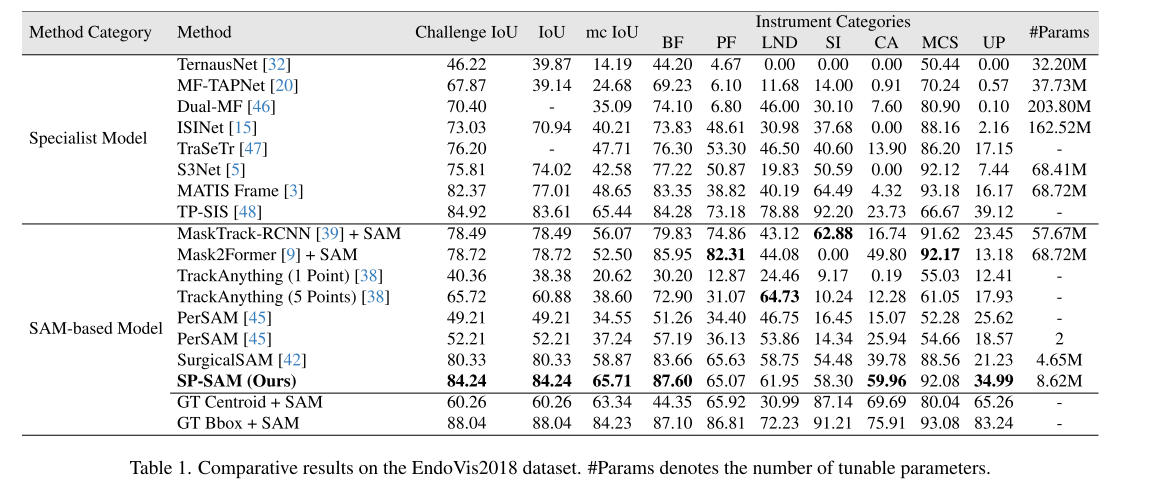

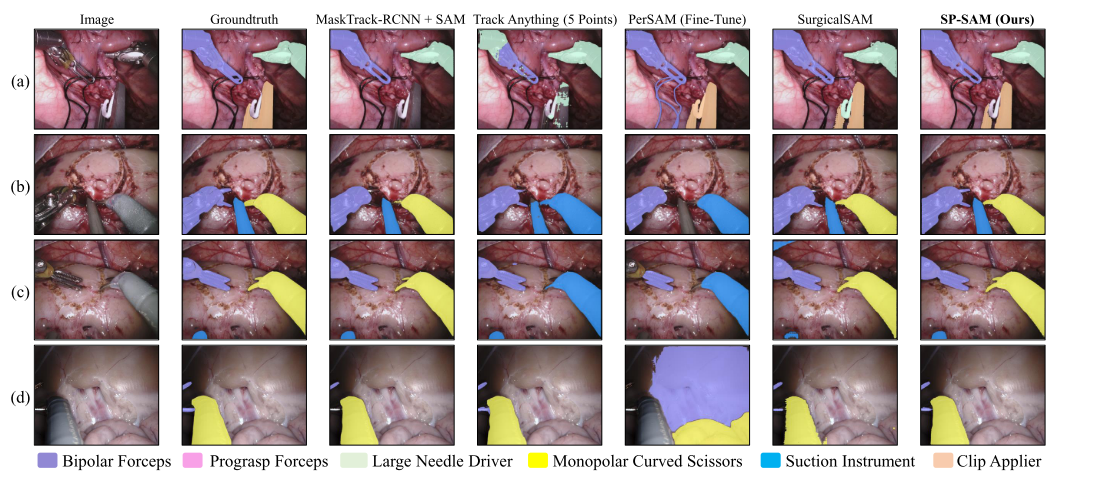

像Segment Anything Model(SAM)这样的基础模型已经在通用对象分割中展示了前景。然而,直接将SAM应用于手术器械分割提出了关键挑战。首先,SAM依赖于每帧点或框提示,这使外科医生与计算机的交互复杂化。此外,SAM在分割手术器械方面产生次优性能,这是由于其预训练中的手术数据不足以及各种手术器械的复杂结构和细粒度细节。为了解决这些挑战,在本文中,我们调查的文本可识别的手术器械分割,并提出SP-SAM(SurgicalPart-SAM),一种新的有效的调整方法,集成了手术器械的结构知识与通用的分割知识的SAM。具体而言,我们通过提出(1)文本形式的协作提示“[part name] of [instrument category name]”,将仪器分解为细粒度的部分;(2)跨模态提示编码器,将文本提示与视觉嵌入联合编码为区分性的部分级表示;以及(3)部分到整体的选择性融合和分层解码策略,其选择性地将部分级表示组装成整体以用于精确的仪器分割。SP-SAM在此基础上获得了更好的理解手术器械结构和区分各种类别的能力。在EndoVis 2018和EndoVis 2017数据集上进行的大量实验证明了SP-SAM的最先进性能,可调参数最少。代码位于https:github.com/wenxi-yue/SurgicalPart-SAM。

Keywords:基础模型,器械分割,文本提示,跨模态

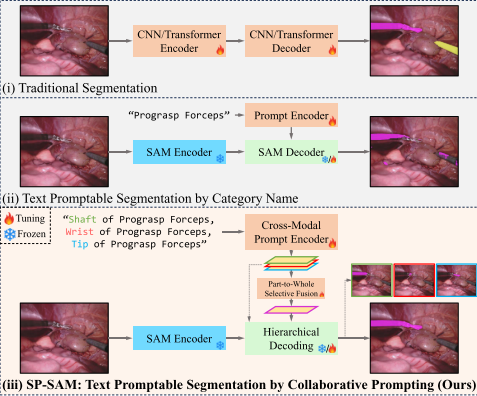

手术器械分割的目的是准确地识别和描绘手术场景中的手术器械。我们确定了两个主要问题与现有的方法,这项任务。首先,他们经常开发需要对所有参数进行全面训练的专业模型如下图,导致开发成本很高。第二,当前的方法缺乏人机交互能力,而人机交互能力是计算机视觉中高度期望的。

Segment Anything Model(SAM)是一个开创性的可扩展细分基础模型。由于其丰富的预先培训知识和互动性,它在解决上述问题方面具有巨大潜力。然而,仍然存在一些基本的挑战,阻碍SAM在手术器械分割中的应用。首先,SAM对点或框提示的依赖在外科设置中是不切实际的,其中外科医生不可能为每个帧中的每个器械提供这样的提示。相反,更灵活和有效的提示,如自由形式的文本将是优选的(例如,通过语音识别和语音控制)。其次,由于预训练中的手术数据不足以及各种类别手术器械的复杂结构和细粒度性质,SAM在分割手术器械方面表现出低于标准的零样本泛化。

在本文中,我们研究了文本可识别的手术器械分割,并提出了一种新的框架,SPSAM(SurgicalPart-SAM),它通过利用SAM的通用分割能力,同时通过一个有效的模型调整方案如上图的iii,整合器械结构信息,解决了上述挑战。对于文本提示分割,通常的做法是使用对象名称来提示感兴趣对象的分割。然而,由于其专业和抽象的性质,文书的类别名称并不适合用作文本提示。为此,我们引入了一种新形式的文本提示,即协作提示,使用文本描述集:{“[part name] of [instrument category name]”} 用于仪器类别的所有部分。它结合了类别和部件信息,有效地将器械类别的专业化、抽象和粗略的概念分解为更精确和细粒度的器械部件,这更适合于结构复杂度高的手术器械。

为了对这些协作提示进行编码,我们引入了跨模态提示编码器,通过视觉-文本交互将协作提示转换为SAM的掩码解码器的部分级别的稀疏和密集提示嵌入。这使得能够集中学习每个仪器部件的细粒度表示,增强对细微细节的分割。最后,为了将仪器结构知识融入到模型中,提出了部分到整体的选择性融合和分层解码策略。具体来说,我们自适应地组装学习的部分级稀疏和密集嵌入,同时考虑特定于类别和特定于图像的部分权重,以预测整个仪器的掩码。然后,对整个器械及其部件进行分层解码,以增强对手术器械的整体和部件水平的理解。

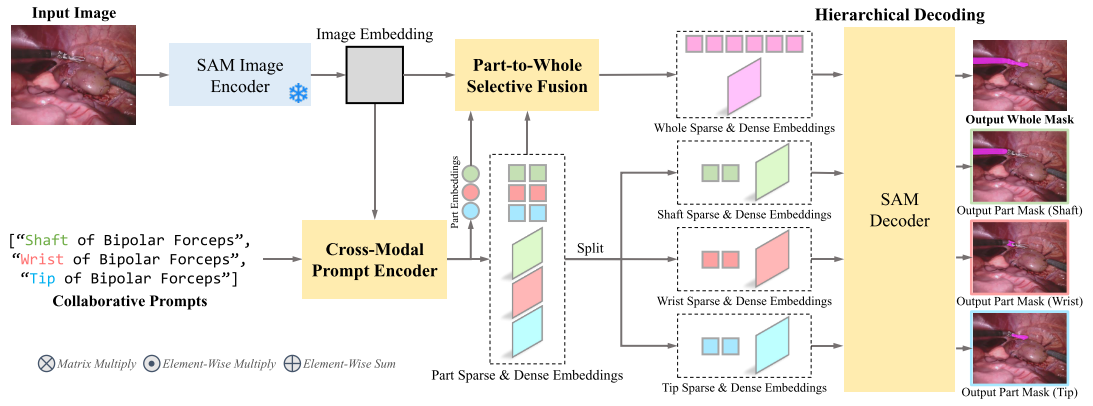

在本文中,我们解决的任务,文本可解释的手术器械分割。仪器类别名称由于其专业化、抽象和粗糙的性质,不适合用作文本提示。因此,我们引入了协同文本提示,联合收割机结合类别和部分信息的手术器械。为了最大限度地发挥这些协作提示的潜力,并将仪器结构信息与SAM的一般知识相结合,我们提出了一个基于SAM的部分到整体的协作提示管道-SP-SAM。给定大小为H×W的手术图像I ∈ RH×W×3,以及协作文本提示T(c)用于器械类别c,SP-SAM预测器械的二进制掩码M(c)∈ {0,1}H×W。

在协同提示下,通过建立类别-部件关系矩阵,可以方便地集成器械结构信息,其中C和P分别表示手术器械类别和器械部件的数量,DCP中的每个元素dcp表示部件p在类别c中的存在。例如,单极弯曲剪刀由轴和尖端部分组成,这些部分将为1,而手腕等缺失部分将为0。SP-SAM利用DCP之前的工具结构进行精确的手术分割。

如下图所示,SP-SAM由四个关键组件组成:SAM图像编码器、跨模式提示编码器、部分到整体选择性融合模块和SAM解码器。SAM图像编码器和CLIP文本编码器(在跨模态提示编码器内)被冻结,其余权重被调整。SP-SAM通过协同提示、部分到整体的选择性融合和分层解码实现了文本可识别的手术器械分割。

跨模态提示编码器:

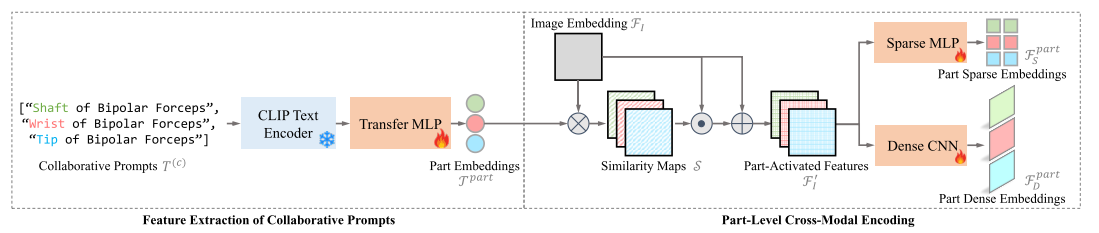

跨模态提示编码器将协作提示和图像嵌入作为输入,并通过空间注意力在它们之间执行跨模态交互,生成部分稀疏嵌入和部分密集嵌入。如下图所示,该过程可以分为两个步骤:协作文本的特征提取和部分级跨模态编码。

协助提示的特征提取:我们介绍了一种新型的文本提示手术器械,协作集成类别和部分信息,即协作提示。具体地,针对类别c的仪器的协作提示被公式化为包含所有P部分的文本集合:,其中仪器categoryc和partp分别表示针对仪器类别c和部件p的文本中的名称。接下来,被CLIP文本编码器编码为基于文本的CLIP部分嵌入。这里的一个挑战是SAM和CLIP的嵌入空间之间的固有分布失配。为了将CLIP文本嵌入转换到SAM的嵌入空间中,设计了一个可调的Transfer MLP,并将其应用于Tpart裁剪,得到部分的转换嵌入,即部分嵌入Tpart ∈ RP×d,其中d与SAM图像特征的嵌入通道数相匹配。

部分级跨模态编码:在该步骤中,部分嵌入Tpart通过空间注意力与图像嵌入交互,并且所获得的部分激活特征用于生成部分稀疏和密集嵌入。具体地,SAM图像编码器提取图像嵌入FI ∈ Rh×w×d,其中h × w是特征尺寸。然后,我们通过计算每个部分的相似性映射来设计空间注意机制,导致,其中⊤表示转置算子。这些相似性映射充当部分感知的空间注意来激活图像嵌入,将FI扩充为,其中F_I和S被广播到相同的大小,并且表示Hadamard乘积。部分激活特征F′ I包含图像和协作提示的信息,分别用两层MLP和三层CNN计算部分稀疏嵌入和部分密集嵌入。这里n表示每个部分的稀疏令牌的数量。然后将这些嵌入送入SAM解码器,以分割相应的仪器部分。

部分对整体的选择性融合:

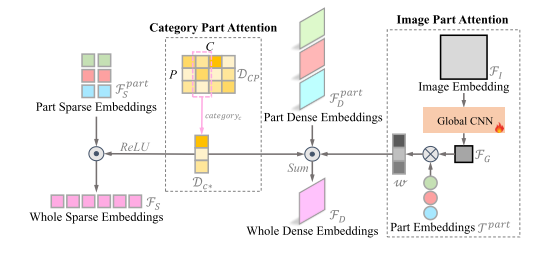

在部分到整体选择性融合模块中,所有部分的稀疏和密集嵌入被选择性地融合以形成整体稀疏和密集嵌入,{FS,FD},用于整个仪器的分割。通过类别部分注意力和图像部分注意力实现选择性融合,如下图所示。具体来说,部分稀疏和密集嵌入由所有P部分的提示嵌入组成。然而,正如D_cp所确定的,一类仪器只包括这些部分的一个子集。因此,我们建议使用DCP中提示类别c的部件权重的类别部件注意作为权重,比如,将稀疏嵌入和密集嵌入从局部层次融合到整体层次。请注意,DCP初始化为0和1,但在模型训练期间动态更新。

虽然类别部件注意力基于专家知识提供类别特定的部件权重,但由于不同的视野和遮挡,每个部件对仪器的存在和贡献在图像中可能会有很大差异。因此,有必要使部分到整体的融合适应于每幅图像的条件。因此,我们提出了图像部分注意力计算图像特定的部分权重,通过学习图像的全局描述符,并计算其与部分嵌入的相似性。特别地,全局描述符FG ∈ R1×d是从具有全局CNN的图像嵌入FI中学习的,该全局CNN由三个卷积层和一个线性层组成。然后,图像特定的部分权重被计算为:

。

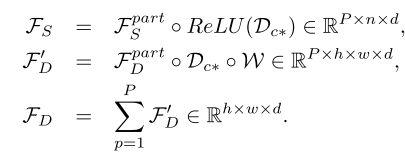

最后,给定类别特定的部分权重Dc和图像特定的部分权重W,我们将部分的稀疏和密集嵌入{Fpart S,Fpart D }融合到整个仪器的稀疏和密集嵌入{FS,FD}中,如下所示。注意,在Hadamard乘积之前,所有矩阵都被广播到相同的大小。

分级解码:

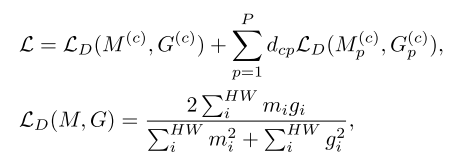

将整体级和部分级的稀疏和密集嵌入送入SAM解码器进行分层解码。这明确地指导模型学习手术器械的整体特征以及部件结构。因此,最终损失函数包括整个分割掩码和部分分割掩码的骰子损失

其中mi和gi分别表示像素i处的预测的logit值和真实二进制值。和分别是仪器及其部件的预测掩模。和分别是仪器及其部件的gt。